- WIADOMOŚCI

Rafał Trzaskowski czy Karol Nawrocki - fejkowe konta pomagają obu. Komu bardziej? [MAMY RAPORT]

Fałszywe konta w mediach społecznościowych publikują treści na temat Rafała Trzaskowskiego oraz Karola Nawrockiego przed II turą wyborów prezydenckich - tak wynika z raportu dla CyberDefence24. Jakie narracje szerzą fejkowe profile i czy ich aktywność może realnie wpłynąć na końcowy wynik?

Redakcja CyberDefence24.pl otrzymała kolejny raport na temat aktywności nieautentycznych kont w mediach społecznościowych od NowaComm, która do badań zastosowała technologię Cyabra.

Raport przedstawia wyniki analizy dyskusji prowadzonych na platformach X i Facebook wokół Rafała Trzaskowskiego i Karola Nawrockiego. Badanie opierało się na monitorowaniu słów kluczowych oraz hashtagów i objęło łącznie 4 394 profili, które wygenerowały 7 318 postów i komentarzy.

Spośród 2 347 kont uczestniczących w rozmowach na temat Rafała Trzaskowskiego, 458 (19%) zostało zidentyfikowanych jako fałszywe. Odpowiadały one za 623 posty i komentarze, czyli 17% wszystkich treści dotyczących kandydata.

W przypadku Karola Nawrockiego przeanalizowano 2 476 profili. 529 z nich (21%) zakwalifikowano jako fałszywe. Te konta były źródłem 793 postów i komentarzy, co stanowiło 20% wszystkich publikacji na jego temat.

Promowanie oraz atakowanie kandydatów

Aby lepiej zrozumieć kierunek narracji i ton wypowiedzi publikowanych przez fałszywe profile, każdą wypowiedź przyporządkowano do jednej z trzech kategorii: pozytywnej, negatywnej lub neutralnej. Analiza pozwoliła określić rozkład sentymentu w treściach publikowanych przez nieautentyczne konta komentujące obu kandydatów, którzy weszli do II tury.

Spośród 623 postów i komentarzy wygenerowanych przez fałszywe profile w kontekście Rafała Trzaskowskiego, 21% miało wydźwięk pozytywny, 21,2% - negatywny, a 57,8% zostało zaklasyfikowanych jako neutralne.

W przypadku Karola Nawrockiego analiza 793 wypowiedzi opublikowanych przez fałszywe konta wykazała, że 25,3% miało charakter pozytywny, 16,1% - negatywny, a 58,6% oceniono jako neutralne.

Dane te pokazują, że fejkowe profile na platformie X oraz Facebooku są zaangażowane zarówno w atakowanie kandydatów, jak i promowanie pozytywnego przekazu na ich temat.

Zobacz też

Analiza narracji wokół Rafała Trzaskowskiego

Cyabra przeanalizowała wzmianki o Rafale Trzaskowskim, skupiając się na toczących się wokół niego dyskusjach. Fałszywe profile nie promowały jednej, spójnej narracji - przeciwnie, wprowadzały do debaty sprzeczne przekazy. Część z nich wychwalała Trzaskowskiego, inne go atakowały, a wiele ograniczało się do powielania sondaży i neutralnych informacji.

W treściach pozytywnych Trzaskowski był przedstawiany jako silny i popularny lider. Fałszywe konta publikowały entuzjastyczne komentarze, takie jak „wygrał wybory”, często przesadnie eksponując jego poparcie, co mogło służyć budowaniu wrażenia szerokiego społecznego uznania.

Z drugiej strony, część kont starała się go zdyskredytować, kreśląc wizję jego rządów jako katastrofy dla kraju. Tego typu wrogie przekazy miały na celu wzbudzenie nieufności i przekierowanie poparcia w stronę rywali, takich jak Sławomir Mentzen czy Karol Nawrocki.

Połączenie pochwał i ostrych ataków sugeruje skoordynowaną próbę wpływania na odbiór Rafała Trzaskowskiego z różnych stron, zamiast promowania jednej konkretnej narracji.

Analiza narracji wokół Karola Nawrockiego

Analiza Cyabry dotycząca wzmianek o Karolu Nawrockim wskazuje na wyraźne ślady skoordynowanej kampanii, mającej na celu jego promowanie i jednoczesne osłabianie rywala. Wiele z fałszywych kont powielało niemal identyczne komunikaty, kreujące wizerunek Nawrockiego jako patrioty i jedynego godnego przywódcy Polski.

Często powtarzała się fraza „Tylko Karol Nawrocki”, co świadczy o wykorzystaniu zaplanowanego, szablonowego przekazu. Badanie powiązań między kontami ujawniło, że fałszywe profile tworzyły silnie zintegrowaną sieć. Wykazywały wysoki poziom wzajemnej aktywności - regularnie się obserwowały, lajkowały, komentowały i udostępniały nawzajem swoje treści, co może wskazywać na centralne zarządzanie z jednego źródła.

Zobacz też

Pozytywny przekaz z większym zasięgiem

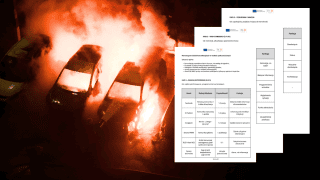

Poniższa tabela przedstawia podsumowanie danych przedstawionych w raporcie wraz ze wskazaniem potencjalnych zasięgów, które te posty mogły osiągnąć.

Kategoria potencjalnego zasięgu szacuje liczbę możliwych wyświetleń generowanych przez posty z nieautentycznych profili, pokazując, jak daleko ich przekazy mogły się rozprzestrzenić w mediach społecznościowych i jak szkodliwy wpływ mogły wywrzeć.

Autor. Cyabra

Dane wskazują, że przekaz o pozytywnym wydźwięku osiąga zdecydowanie większy zasięg i wyższe zaangażowanie niż treści negatywne. Zarówno w przypadku Rafała Trzaskowskiego, jak i Karola Nawrockiego, pozytywne komunikaty były szerzej rozpowszechniane i budziły większy odzew wśród odbiorców.

O komentarz w tej sprawie poprosiliśmy sztaby wyborcze obu kandydatów. Do czasu publikacji artykułu nie uzyskaliśmy odpowiedzi.

Wpływ na wybory prezydenckie

Dezinformacja i działalność fałszywych kont mają destrukcyjny wpływ na spójność społeczną. Głównym celem wielu operacji wpływu jest polaryzacja opinii publicznej poprzez wzmacnianie istniejących podziałów i antagonizmów między różnymi grupami społecznymi. Fałszywe treści, często bazujące na uprzedzeniach i stereotypach, prowadzą do eskalacji konfliktów i wzrostu napięć.

Stanowi to bezpośrednie zagrożenie dla fundamentów demokracji, w szczególności dla uczciwości i transparentności procesów wyborczych oraz zdolności obywateli do podejmowania świadomych decyzji politycznych. Czy jednak fałszywe konta mogą wpłynąć na ostetczny wynik wyborów?

„Fałszywe konta są wykorzystywane w kampaniach i operacjach wpływu od wielu lat. Przykłady takich działań obserwowaliśmy zarówno w Polsce, jak i za granicą. Ich wpływ jest realny - mogą generować sztuczny ruch w mediach społecznościowych, promować konkretne hashtagi, zwiększać zasięg postów i widoczność wybranych treści. W rezultacie takie działania mogą skutecznie wzmacniać przekaz i manipulować percepcją odbiorców. Należy też pamiętać, że liczne komentarze - zarówno pozytywne, jak i dyskredytujące - mogą wpływać na postawy wyborców, tworząc wrażenie szerokiego poparcia lub sprzeciwu wobec określonych poglądów” - wyjaśnia Aleksy Szymkiewicz ze Stowarzyszenia Demagog.

Kto stoi za fałszywymi kontami?

Raport nie wskazuje bezpośrednio, kto odpowiada za prowadzenie fałszywych kont, które są zaangażowane w publikowanie treści w mediach społecznościowych na temat obu kandydatów. Zidentyfikowanie konkretnych osób lub grup stojących za fałszywymi kontami jest często utrudnione ze względu na anonimowość, jaką oferuje internet oraz stosowanie zaawansowanych technik maskowania.

Wśród podmiotów, które mogą stać fałszywymi kontami są m.in. aktorzy państwowi, tacy jak Rosja. Jej działania mają na celu destabilizację sytuacji politycznej, pogłębianie polaryzacji społecznej, osłabianie sojuszy (np. NATO, UE) oraz promowanie rosyjskich interesów geopolitycznych.

Fałszywe konta mogą być także wykorzystywane przez podmioty wewnętrzne do dyskredytowania przeciwników politycznych. Za fałszywymi kontami mogą stać również grupy ideologiczne dążące do promowania określonych poglądów.

Fałszywe konta podstawą do unieważnienia wyborów?

Czy publikowanie określonych treści z fałszywych kont w mediach społecznościowych mogłoby stanowić podstawę do unieważnienia wyborów? Decyzję w tej sprawie podejmuje Sąd Najwyższy, ale zapada ona jedynie w nadzwyczajnych sytuacjach, np. w przypadku ingerencji w przebieg wyborów ze strony innego państwa.

Konieczne w tym przypadku byłoby udowodnienie, że miała miejsce zewnętrzna ingerencja, która wpłynęła na końcowy wynik wyborów. Taka sytuacja miała miejsce w Rumunii, gdzie Sąd Konstytucyjny unieważnił I turę wyborów prezydenckich, uznając, że rosyjska operacja z wykorzystaniem dziesiątek tysięcy fałszywych kont na TikToku wpłynęła na wynik głosowania. Pisaliśmy o tym szerzej na łamach CyberDefence24.

Skala działalności fałszywych kont w okresie badania w Polsce nie była na tyle duża, aby mogła stanowić podstawę do unieważnienia wyborów. Bez wątpienia jednak służby zajmujące się cyberbezpieczeństwem mają w ostatnich tygodniach dużo pracy. Aktywność fałszywych kont oraz rosnący problem dezinformacji w mediach społecznościowych pokazuje, jak ważne jest krytyczne myślenie oraz weryfikacja informacji.

„Za działalnością fałszywych kont mogą stać zarówno służby obcych państw, jak i prywatne firmy oferujące usługi prowadzenia kampanii wpływu w sieci - jeden z takich przypadków niedawno opisywaliśmy. Kwestie prawne powinny być oceniane przez właściwe instytucje, a sprawą powinny zająć się odpowiednie służby, zwłaszcza w kontekście trwającej kampanii wyborczej. Tego typu działania wymagają stanowczej reakcji i ochrony społeczeństwa przed manipulacją oraz operacjami wpływu” - wyjaśnia ekspert ze Stowarzyszenia Demagog.

Komentarz NASKu

O komentarz w sprawie działaności fałszywych kont w mediach społecznościowych przed II turą wyborów prezydenckich poprosiliśmy NASK.

„Na podstawie codziennej pracy i monitoringu infosfery (w tym mediów społecznościowych) przez analityków OAD NASK można wskazać, że fałszywe konta (boty, tj. przede wszystkim konta wykazujące skoordynowane nieautentyczne zachowania - CIB - Coordinated Inauthentic Behavior) są aktywne w dyskursie online również przed drugą turą wyborów prezydenckich. W ramach monitorowanych przez nas operacji możemy stwierdzić, że w polskiej infosferze działają siatki kont, które podejmują próby promowania treści, mogących mieć wpływ na preferencje wyborcze Polaków. Celem OAD NASK jest stały monitoring, zarówno pod kątem wystąpienia CIB, jak i zaistnienia ryzyka zewnętrznej ingerencji, aktualnych narracji dezinformacyjnych czy też pojawienia się deepfejków o charakterze wyborczym” - wyjaśnia NASK w odpowiedzi dla naszej redakcji.

Podejmowane są także działania w celu ograniczenia działalności takich kont, choć jak przyznaje NASK wpływ operacji z wykorzystaniem nieautentycznych profili na decyzje wyborów jest trudny do zmierzenia.

Wiele z siatek botów jest niezwłocznie zgłaszanych do platform przez analityków OAD, w efekcie czego konta te są zdejmowane. Obserwujemy także aktywność i działalność botów wyborczych w polskiej infosferze. Jednak wpływ tego typu operacji na decyzje wyborców jest niemierzalny, ponieważ nie istnieją niezawodne metody, ani narzędzia, by oszacować skalę realnego oddziaływania. Niewątpliwie jednak, każda operacja dezinformacyjna prowadzona w infosferze zostawia pewien ślad w środowisku informacyjnym, stąd tak ważne jest budowanie świadomości oraz odporności społeczeństwa w zakresie przeciwdziałania dezinformacji. Jednym z naszych głównych celów jest monitoring infosfery oraz skuteczne doprowadzanie do zablokowania pojedynczych kont-botów lub siatek botów. Jako przykład naszych skutecznych działań tylko z ostatnich dni możemy wskazać: wykrycie i zgłoszenie 71 kont CIB, które publikowały w serwisie X i Facebook fałszywe wypowiedzi rzekomych wyborców oraz m.in. zidentyfikowanie i zaraportowanie 3347 nowych kont działających w ramach operacji Overload w serwisie X, która pośrednio dotyczyła wyborów w Polsce, a głównie była skierowana do anglojęzycznych odbiorców.

NASK

Zapytaliśmy także, czy działalność takich kont może być prowadzone przez obce państwa.

„Działalność w ramach CIB może być inspirowana przez obce służby. OAD NASK dokłada wszelkich starań w celu przeciwdziałania operacjom wpływu poprzez monitoring mediów społecznościowych – nie tylko w okresie wyborczym. Zarówno techniki, jak i narzędzia i konkretne operacje są stale identyfikowane oraz raportowane do administracji poszczególnych platform społecznościowych, a w razie podejrzenia obcej ingerencji w proces wyborczy - do służb” - tłumaczą eksperci z NASKu.

Serwis CyberDefence24.pl otrzymał tytuł #DigitalEUAmbassador (Ambasadora polityki cyfrowej UE). Jeśli są sprawy, które Was nurtują; pytania, na które nie znacie odpowiedzi; tematy, o których trzeba napisać – zapraszamy do kontaktu. Piszcie do nas na: [email protected].

Krajowy system e-Faktur - co musisz wiedzieć o KSEF?

Materiał sponsorowany