- WIADOMOŚCI

Powstanie organ nadzoru nad AI. Projekt ustawy trafił do konsultacji społecznych

Projekt ustawy o systemach sztucznej inteligencji zakłada powołanie organu nadzoru nad AI. Regulacja trafiła już do konsultacji społecznych. Co jeszcze przewiduje nowe prawo?

Autor. Ministerstwo Cyfryzacji / X

Badania wskazują, że obecnie około 6 proc. firm w Polsce wykorzystuje systemy sztucznej inteligencji, a według wiceministra w rzeczywistości odsetek głębokiego wykorzystania AI jest mniejszy. Resort chce to zmienić, w czym mają pomóc przepisy implementujące unijny Akt o sztucznej inteligencji.

„Chcemy usprawnić i uelastycznić wdrażanie sztucznej inteligencji w Polsce. Chcemy, żeby przepisy i regulacje nie były ograniczeniem, tylko okazją do upowszechniania wykorzystania AI w Polsce” – przekazał Standerski podczas konferencji, która miała miejsce 16 października.

Wiceminister przedstawił główne założenia ustawy o systemach AI. Dokument jest już także dostępny w Rządowym Centrum Legislacji.

"Chcemy, żeby dzięki projektowi ustawy o sztucznej inteligencji oraz innym działaniom Ministerstwa Cyfryzacji coraz więcej polskich firm oraz polskich instytucji korzystało z AI i żebyśmy na końcu my wszyscy jako obywatelki i obywatele mogli korzystać z technologii, które… pic.twitter.com/1Qiycsfq28

— Ministerstwo Cyfryzacji (@CYFRA_GOV_PL) October 16, 2024

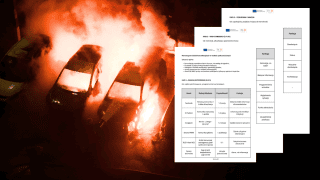

Komisja Rozwoju i Bezpieczeństwa Sztucznej Inteligencji

Ustawa powołuje Komisję Rozwoju i Bezpieczeństwa Sztucznej Inteligencji. Członkami komisji będą m.in. przedstawiciele ministra cyfryzacji, KPRM, Prezesa Urzędu Ochrony Danych Osobowych, Prezesa UOKiK, Komisji Nadzoru Finansowego, Rzecznika Praw Obywatelskich, Rzecznika Praw Dziecka, Krajowej Rady Radiofonii i Telewizji, a także Prezesa Urzędu Komunikacji Elektronicznej.

Do głównych zadań Komisji będzie należała kontrola przestrzegania przepisów, nadzór rynku, tworzenie piaskownic regulacyjnych, przyjmowanie skarg oraz dbanie o bezpieczeństwo systemów AI.

Jak czytamy w uzasadnieniu ustawy, zadania komisji będą obejmowały „podejmowanie działań mających na celu przeciwdziałanie zagrożeniom w zakresie bezpieczeństwa systemów sztucznej inteligencji, w tym przyjmowania zgłoszeń w sprawach dotyczących poważnych incydentów”.

Dobre praktyki i interpretacje

Komisja Rozwoju i Bezpieczeństwa Sztucznej Inteligencji zajmie się także publikowaniem dobrych praktyk, czyli rekomendacji wykorzystania sztucznej inteligencji w bezpieczny sposób.

Do zadań Komisji będzie również należało dokonywanie interpretacji indywidualnych (dla konkretnych firm) i generalnych (dla całego sektora).

„Technologie zmieniają się zdecydowanie szybciej niż jest w stanie zainterweniować ustawodawstwem. Dlatego proponujemy wprowadzenie interpretacji, po to, żeby każda firma, która chce wypuścić na rynek zupełnie nowe narzędzia oparte na AI, mogła wcześniej otrzymać potwierdzenie od Komisji, że rozwiązanie, które chce wprowadzić, jest bezpieczne i zgodne z Aktem o sztucznej inteligencji” – tłumaczy Standerski.

Komisja się rozrasta. Co z kosztami?

Co ciekawe wiceminister cyfryzacji przyznał podczas konferencji, że Komisja Rozwoju i Bezpieczeństwa Sztucznej Inteligencji ma liczyć około 100 członków i członkiń.

Kiedy redakcja CyberDefence24.pl rozmawiała z Dariuszem Standerskim w sierpniu – mówił on o kilku, maksymalnie kilkunastu pracownikach.

„Uważam, że do takiej komisji nie powinno wchodzić wiele osób. Tak, żeby z jednej strony, zapewnić wielorakość perspektyw, a z drugiej, żeby ta komisja była elastyczna, decyzyjna i mogła skutecznie pracować. Jeśli w jednym miejscu jest za dużo ludzi, praca staje się trudna” – mówił wiceminister w rozmowie z nami.

Stwierdził wtedy, że Komisja może kosztować docelowo od 20 do 30 mln złotych rocznie. Ta kwota prawdopodobnie jest już nieaktualna.

Społeczna Rada do spraw Sztucznej Inteligencji

Ustawa powołuje jeszcze jeden nowy organ: Społeczną Radę do spraw Sztucznej Inteligencji. Ma ona funkcję opiniodawczo-doradczą wobec Komisji.

Nie zamykamy się tylko na instytucje publiczne. Chcemy, żeby w pracach Komisji brały udział również związki złożone z przedstawicieli i przedstawicieli organizacji pozarządowych, tak żeby również perspektywa etyki sztucznej inteligencji, sztucznej inteligencji godnej zaufania, czy perspektywa społeczeństwa obywatelskiego była silnie reprezentowana właśnie w ramach prac Społecznej Rady.

Wiceminister Cyfryzacji Dariusz Standerski

W Radzie będą zasiadać także przedstawiciele biznesu.

Wyzwanie dla energetyki

Jak podkreślał Standerski – w ustawie znajduje się zobowiązanie dla ministra cyfryzacji do corocznego publikowania informacji i prognoz dotyczących mocy obliczeniowych i zużycia energii elektrycznej związanych z rozwojem sztucznej inteligencji.

Minister właściwy do spraw informatyzacji, na podstawie informacji udzielonej przez ministra właściwego do spraw nauki i szkolnictwa wyższego, do 31 marca każdego roku przekazuje Radzie Ministrów oraz Komisji informację na temat wymaganych zasobów obliczeniowych do dalszego rozwoju systemów sztucznej inteligencji i prognozowanego zużycia energii z tego tytułu.

Art. 66, 3) Projektu ustawy o systemach sztucznej inteligencji

Wiceminister cyfryzacji zwrócił uwagę na potrzebę przeprowadzenia kwerendy obecnego stanu mocy obliczeniowych oraz monitorowania ich zużycia na każdy projekt sztucznej inteligencji, a także zużycia energii elektrycznej w tym kontekście.

„Stoimy przed wyzwaniem, które wychodzi daleko poza cyfryzację. Jest to wyzwanie dotyczące energetyki oraz infrastruktury. Dzięki takim informacjom i takim prognozom będziemy przygotowani na planowanie rozwoju sztucznej inteligencji w Polsce” – skomentował Standerski.

Co dalej z ustawą o systemach sztucznej inteligencji?

Ustawa trafiła obecnie do konsultacji społecznych.

Chciałbym, żebyśmy dzisiaj rozpoczęli rzetelne, długie i aktywne konsultacje społeczne. W tym względzie mamy jeszcze lekcje do odrobienia. Nigdzie nie musimy się spieszyć. Jesteśmy jednymi z pierwszych w Europie, jeżeli chodzi o regulacje dotyczące wdrożenia Aktu sztucznej inteligencji, więc mamy czas, żeby zrobić nie tylko pierwsze, ale także najlepsze regulacje.

Wiceminister Cyfryzacji Dariusz Standerski

Przypomnijmy, że przepisy AI Actu dotyczące systemów zakazanych będą obowiązywać od 2 lutego 2025 r., natomiast ostateczny termin na wprowadzenie wszystkich regulacji upływa 2 sierpnia 2027 r.

Serwis CyberDefence24.pl otrzymał tytuł #DigitalEUAmbassador (Ambasadora polityki cyfrowej UE). Jeśli są sprawy, które Was nurtują; pytania, na które nie znacie odpowiedzi; tematy, o których trzeba napisać – zapraszamy do kontaktu. Piszcie do nas na: [email protected].

Krajowy system e-Faktur - co musisz wiedzieć o KSEF?

Materiał sponsorowany