- WIADOMOŚCI

AI rozpoznaje twarze zmarłych podczas wojny w Ukrainie, ale nie tylko

Ukraińskie władze wykorzystują kontrowersyjną technologię rozpoznawania twarzy do identyfikowania ciał ofiar. Stosować ją jednak miały już w czasie pokoju, co rodzi pytania o prawo do prywatności. Czy takie dylematy tłumaczy potrzeba odkrycia tożsamości podczas wojny?

O tym, że technologia rozpoznawania twarzy ClearView oparta na sztucznej inteligencji jest wykorzystywana przez ukraińskie ministerstwo obrony - co potwierdzał Hoan Ton-That, dyrektor generalny ClearView AI - pisaliśmy na łamach CyberDefence24.pl już w połowie marca br.

Choć technologia opracowana przez firmę Clearview AI wzbudza kontrowersje, wiadomo już oficjalnie, że przekazano ją ukraińskiemu rządowi, a jak podaje teraz BBC – są dowody na to, że narzędzie AI jest używane do identyfikacji zarówno żywych, jak i zmarłych w wojnie w Ukrainie.

Na podstawie miliardów zebranych zdjęć z serwisów społecznościowych, takich jak Facebook czy Twitter - w oparciu o bazę danych - możliwe jest wyszukiwanie twarzy. „To trochę działa jak Google. Ale zamiast wstawiać ciąg słów lub tekst, użytkownik wstawia zdjęcie twarzy” – wyjaśnia Ton-That, dyrektor generalny firmy Clearview.

Serwisy takie jak Google, Twitter, Facebook czy YouTube miały wysłać zapytania do Clearview o zaprzestanie wykorzystania zdjęć z ich witryn, a brytyjskie Biuro Komisarza ds. Informacji nałożyo grzywnę za niepoinformowanie ludzi o zbieraniu ich fotografii. Firma jednak do tej pory niewiele sobie z tego robi, twierdząc, że działa w granicach prawa.

Kwestie prywatności

Wykorzystanie tego narzędzia przez ukraiński rząd w czasie wojny ma rodzić pytania o prawo do prywatności. Czy czas konfliktu zbrojnego - w tym przypadku - rządzi się „własnymi prawami”?

Jednak jak podaje BBC, rozwiązanie firmy jest szerzej stosowane: 3,2 tys. agencji rządowych w USA kupiło lub przetestowało tę technologię. Clearview nie jest także pierwszą spółką, która tego typu narzędzie używa - jak przyznał Aric Toler, dyrektor ds. badań w Bellingcat, organizacji specjalizującej się w dziennikarstwie śledczym – stosowano je już w przypadku np. identyfikacji Rosjanina, który sfilmował tortury i zabójstwo więźnia w Syrii.

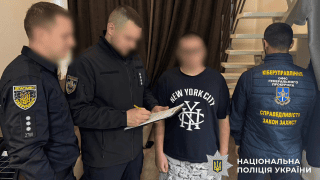

System Clearview miał być także używany w stosunku do żywych – do potwierdzenia prawdziwości danych podejrzanych osób.

Clearview to nie jedyna firma, która stosuje AI

Innym tego typu rozwiązaniem jest FindClone z Rosji, która ma być wsparciem w namierzaniu danych osobowych zmarłych rosyjskich żołnierzy. Za pośrednictwem tego narzędzia można nawet znaleźć osoby, które nie posiadają kont w mediach społecznościowych, co w przypadku np. wojskowych czy osób związanych z branżą bezpieczeństwa - które często unikają obecności w mediach społecznościowych - stanowi poważne zagrożenie.

Krytycy rozwiązania podkreślają, że rozpoznawanie twarzy może przyczynić się do m.in. niesłusznego aresztowania w czasie pokoju lub w czasie wojny – rozstrzelania niewinnych. Jednak zdaniem firmy, technologia jest „w 99 proc. dokładna”.

Kolejnym argumentem są kwestie prywatności – spółka pobiera publicznie dostępne zdjęcia z serwisów społecznościowych do budowy swojej bazy danych, ale nikogo nie pyta o zgodę. Natomiast w Chinach ma być opracowywany plan – jak podawało BBC - wykorzystania technologii rozpoznawania twarzy do atakowania dziennikarzy w ramach szerszego systemu inwigilacji społeczeństwa.

Technologia Clearview jest też stosowana w kontekście wojskowym w innym aspekcie - w zeszłym roku firma podpisała umowę z Pentagonem na zbadanie możliwości zastosowania tej technologii na przykład w okularach rozszerzonej rzeczywistości. Jest jedną z kilku firm rozwijających sztuczną inteligencję w rozpoznawaniu twarzy w wojsku.

Chcemy być także bliżej Państwa – czytelników. Dlatego, jeśli są sprawy, które Was nurtują; pytania, na które nie znacie odpowiedzi; tematy, o których trzeba napisać – zapraszamy do kontaktu. Piszcie do nas na: [email protected]. Przyszłość przynosi zmiany. Wprowadzamy je pod hasłem #CyberIsFuture.

/NB

Serwis CyberDefence24.pl otrzymał tytuł #DigitalEUAmbassador (Ambasadora polityki cyfrowej UE). Jeśli są sprawy, które Was nurtują; pytania, na które nie znacie odpowiedzi; tematy, o których trzeba napisać – zapraszamy do kontaktu. Piszcie do nas na: [email protected].

Krajowy system e-Faktur - co musisz wiedzieć o KSEF?

Materiał sponsorowany