- WIADOMOŚCI

PO używa sztucznej inteligencji do spotu wyborczego. Otwiera Puszkę Pandory?

Platforma Obywatelska wyemitowała spot, w którym używa głosu premiera Morawieckiego, wygenerowanego przy pomocy generatywnej sztucznej inteligencji. Czy nie jest to początek bardzo niebezpiecznego trendu w polskiej polityce?

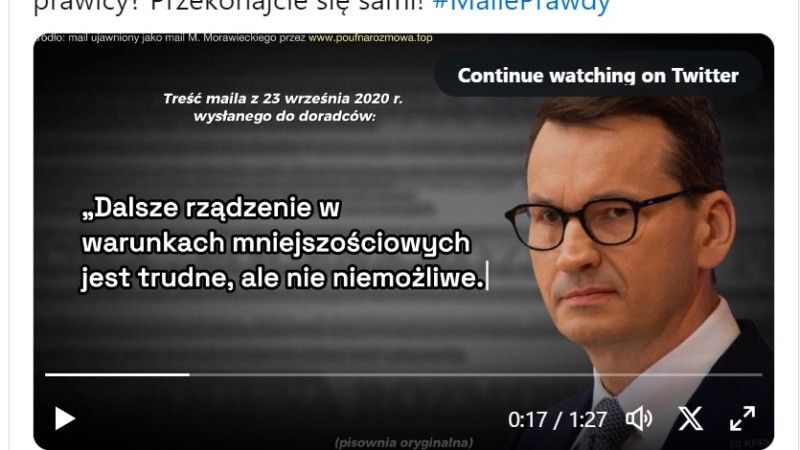

24 sierpnia w mediach społecznościowych Platformy Obywatelskiej (m.in. X i Facebook) ukazał się materiał prezentujący kilka wypowiedzi Mateusza Morawieckiego. Podane cytaty (źródłem ma być serwis Poufna Rozmowa, który przez wiele miesięcy publikuje wiadomości rzekomo pochodzące ze skrzynek rządowych, prawdziwość części z nich potwierdzali nadawcy/odbiorcy tych wiadomości; oficjalnie rząd tego nie potwierdzał, a zaznaczał, że "mogły zostać zmanipulowane") czytane są przez głos polskiego premiera, ale problem w tym, że jest to jego sfabrykowany głos - wygenerowany przez generatywną sztuczną inteligencję.

W tym przypadku opinia publiczna nie dysponuje bowiem oryginalną wersją audio. Materiał prezentuje się w sposób następujący:

Jak tak naprawdę wyglądają relacje w „zjednoczonej” prawicy? Przekonajcie się sami! #MailePrawdy pic.twitter.com/ehytYIqwKf

— PlatformaObywatelska (@Platforma_org) August 24, 2023

"Czerwona lampka"

Choć na pierwszy rzut... ucha słychać, że nagranie nie odtwarza oryginalnego głosu, to nie sposób nie stwierdzić, że w kampanii politycznej w Polsce otwiera się zupełnie nowy rozdział, który może przynieść wiele szkód i wpłynąć na obniżenie poziomu debaty publicznej w Polsce (i tak będącej już na wyjątkowo niskim poziomie – red.).

O komentarz w tej sprawie poprosiliśmy redaktor Sylwię Czubkowską, współautorkę podcastu Techstorie, która skomentowała zaistniałą sytuację w serwisie X (do niedawna Twitter).

Ja wiem wiem zaraz mi się oberwie za symetryzm...

— Sylwia Czubkowska (@sylvcz) August 24, 2023

Ale: gdy wykorzystuje się AI do sztucznego generowania głosu SZCZEGÓLNIE POLITYKA to TRZEBA TO JASNO I WYRAŹNIE OZNACZYĆ.

Inaczej przykłada się rękę do niebezpiecznej zabawy w generowanie półprawd i deep fejków politycznych. https://t.co/i8br6ltGIE

„Na pewno w tej sytuacji powinna zapalić się nam czerwona lampka" – mówi nam redaktor Sylwia Czubkowska, zwracając uwagę na to, że w tym przypadku nie zastosowano zaawansowanych technik deepfake, a raczej semi-deepfake.

„Wykorzystywane są prawdziwe słowa, prawdziwy wizerunek premiera Morawieckiego, ale są to słowa odczytywane przez generatywną sztuczną inteligencję. To nie jest to, do czego AI może być w dalszym rozwoju wykorzystywana" – stwierdziła nasza rozmówczyni.

Podgrzewanie emocji

Według Czubkowskiej - nawet jeśli na omawianym filmie znalazłby się opis mówiący o tym, że część materiału jest wygenerowana przez AI - to byłoby to za mało.

„Opis na samym filmiku byłby ukłonem do odbiorców, ale uważam że to wciąż za mało. (...)Po prostu lepiej nie używać AI w kampaniach wyborczych" - stwierdziła. "Wykorzystanie sztucznej inteligencji w kampanii politycznej, szczególnie gdy budzi ona tak skrajne emocje, może łatwo doprowadzić do sytuacji, w której treści generowane przez AI będą mocno żerowały na emocjach elektoratu, kandydatów i komentatorów" - kontynuowała.

„Prawda nie będzie najważniejsza, najważniejsze będzie to, jakie emocje będą wywołane i jakie będą krótkoterminowe skutki" – podsumowała nasza rozmówczyni.

Co na to politycy?

O komentarz w tej sprawie poprosiliśmy też rzecznika Platformy Obywatelskiej Jana Grabca oraz Rafała Bochenka z Prawa i Sprawiedliwości. Jak tylko uzyskamy odpowiedzi od przedstawicieli obu partii, poinformujemy o tym na naszych łamach.

Serwis CyberDefence24.pl otrzymał tytuł #DigitalEUAmbassador (Ambasadora polityki cyfrowej UE). Jeśli są sprawy, które Was nurtują; pytania, na które nie znacie odpowiedzi; tematy, o których trzeba napisać – zapraszamy do kontaktu. Piszcie do nas na: [email protected].

Krajowy system e-Faktur - co musisz wiedzieć o KSEF?

Materiał sponsorowany