- ANALIZA

- WIADOMOŚCI

#CyberMagazyn: Akta Epsteina w erze AI. Fałszywe zdjęcia zaczynają żyć własnym życiem

W cieniu geopolitycznych napięć i rosnącej polaryzacji politycznej społeczeństwa w Stanach Zjednoczonych sprawa Jeffreya Epsteina regularnie trafia na szczyt internetowych dyskusji. Wraz z publikacją dokumentów coraz częściej nowe, faktyczne informacje mieszają się z tymi wygenerowanymi przez sztuczną inteligencję. Wśród nich w ostatnim czasie znalazły się „fotografie” przedstawiające m.in. Billa Clintona, Stephena Hawkinga czy Donalda Trumpa. Ich zasięg pokazuje, jak bardzo zacieralna jest granica między faktami a manipulacją.

Autor. CyberDefence24/Canva

W kontekście coraz bardziej niestabilnej sytuacji międzynarodowej związanej z prowadzonymi na Bliskim Wschodzie działaniami militarnymi oraz rosnącym napięciem politycznym wewnątrz Stanów Zjednoczonych, temat akt Jeffreya Epsteina powraca jak bumerang.

W atmosferze politycznej polaryzacji i tak intensywnej walki informacyjnej wśród ponad trzech milionów opublikowanych przez Departament Sprawiedliwości plików, regularnie pojawiają się kolejne „odkrycia” nowych dokumentów.

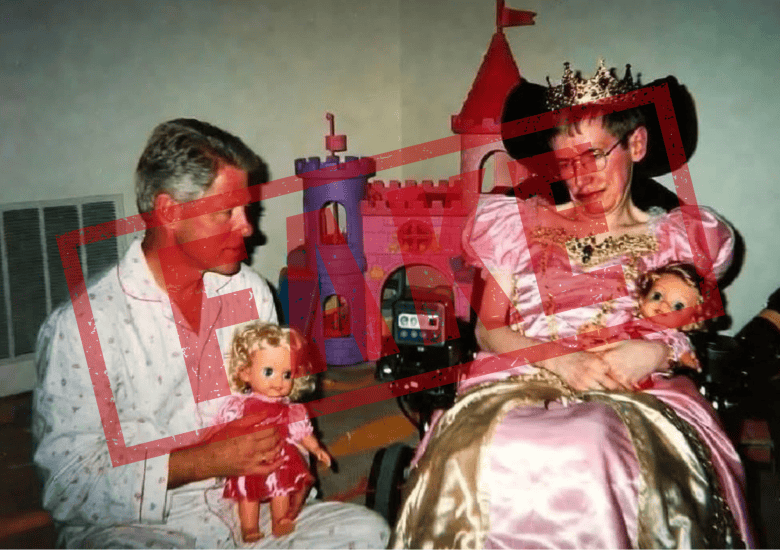

Jedną z krążących w sieci serii fałszywych „zdjęć” stanowią obrazy przedstawiające 42. prezydenta Stanów Zjednoczonych, Billa Clintona oraz fizyka Stephena Hawkinga w niezręcznych sytyacjach. Na jednym z obrazów obydwoje panów siedzi i bawi się lalkami: Hawking ma na głowie koronę i księżniczkową sukienkę, a Clinton ubrany jest w dziewczęcą/kobiecą piżamę.

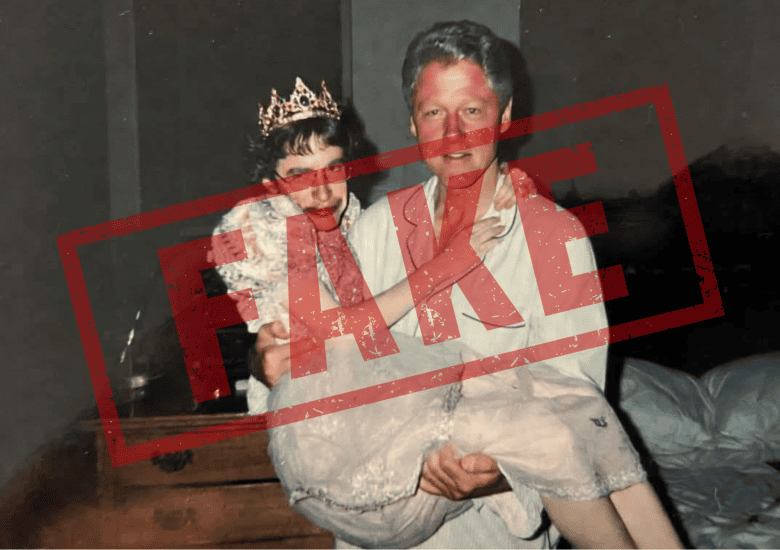

Na kolejnej grafice, utrzymanej w podobnej scenerii, Hawking znajduje się w objęciach Clintona, który trzyma go na rękach.

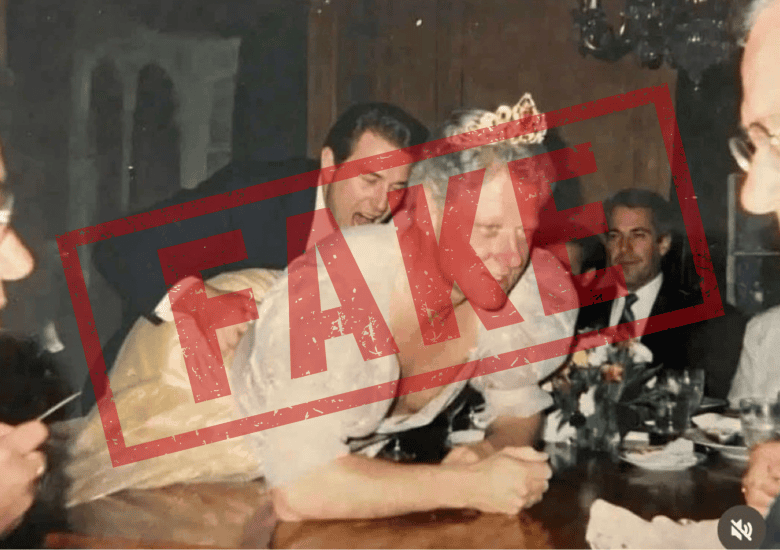

Ostatnia grafika z tej serii (tym razem bez Hawkinga) przedstawia Clintona w sukience i koronia, który pochyla się nad blatem. Za nim stoi mężczyzna w garniturze, który popycha go do przodu. Cała scena przypomina fragment jakiegoś spotkania lub przyjęcia.

Pozostałe dwa obrazki dotyczą Donalda Trumpa, też w towarzystwie Billa Clintona. Na pierwszym z nich Trump klęczy przed fotelem, na którym siedzi Clinton i sięga w kierunku jego paska od spodni. Drugie, przedstawia Trumpa leżącego w łóżku z mężczyzną, który też przypomina byłego prezydenta. Obaj leżą przytuleni i trzymają się za ręce.

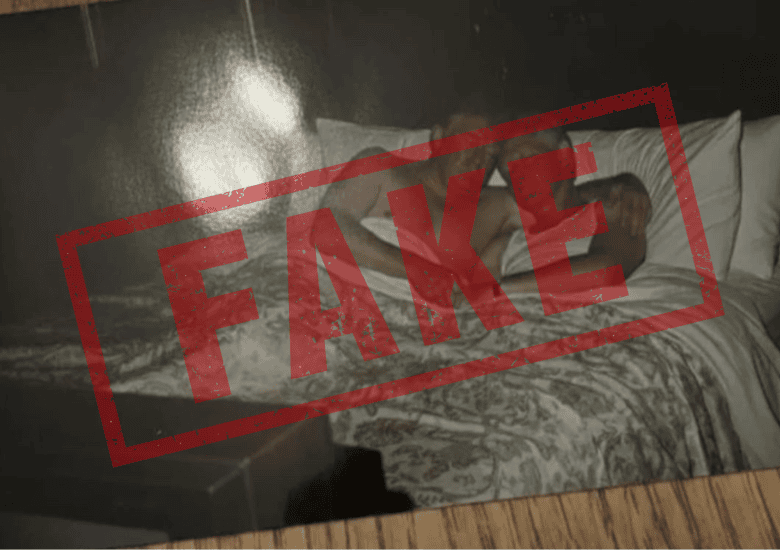

Wszystkie opisane zdjęcia są fałszywe.

Wygenerowane, nie ujawnione

Weryfikacją autentyczności każdego z opisywanych zdjęć zajęła się amerykańska strona fact-checkingowa Snopes.

Według ustaleń, źródłem zdjęć Clintona i Hawkinga była facebookowa grupa „Crazed AI”, gdzie obrazy opublikowano pod koniec lutego i na początku marca 2026 roku.

Autor zdjęć, użytkownik o nazwie Marc-André Lavoie (niepowiązany z kanadyjskim filmowcem), w rozmowie z redakcją podkreślał, że publikował je wyłącznie w grupach jednoznacznie przeznaczonych do dzielenia się treściami generowanymi przez sztuczną inteligencję. Z czasem jednak obrazy zaczęły krążyć w internecie poza tym kontekstem i były przedstawiane jako autentyczne fotografie z akt Epsteina.

Jak stwierdził Lavoie w rozmowie z Snopes:

Kontekst moich zdjęć wydaje mi się tak absurdalny, że nie spodziewałem się, że ktokolwiek uwierzy w ich prawdziwość.

Marc-André Lavoie

A jednak uwierzyli; a do tego obrazy zostały wygenerowane przy użyciu Groka.

Najbardziej rozpowszechnione fałszywe zdjęcie z aktów Epsteina, przedstawiające Trumpa klęczącego przed fotelem, na którym siedzi Bill Clinton, zostało opublikowane już w listopadzie 2025 roku. Obraz ponownie zaczął krążyć w sieci na początku marca br., najczęściej zestawiany z następnym opisywanym zdjęciem.

W momencie powstania, fotografia zdawała się nawiązywać do autentycznej wiadomości e-mail wysłanej przez Marka Epsteina do swojego brata, Jeffreya Epsteina. Mark prosił w niej, by Jeffrey sprawdził u byłego głównego stratega Białego Domu, Steve Bannon, czy „Putin ma zdjęcia Trumpa obciąg… Bubbę”. W przestrzeni medialnej spekulowano wtedy, że przydomek „Bubba” może odnosić się do Clintona, jednak sam Mark Epstein miał później dystansować się od takiej interpretacji.

Mimo że nie udało się ustalić autora obrazu, Snopes, analizując jego autentyczność, zwróciło uwagę na niespójności kontekstowe. Data widoczna na zdjęciu wskazuje październik 2004 roku, co nie współgra z tym, że Bill Clinton w tym czasie dochodził do siebie po operacji pomostowania aortalno-wieńcowego, a także angażował się w kampanię wyborczą Johna Kerry’ego.

Wykorzystanie narzędzi do wykrywania treści generowanych przez sztuczną inteligencję przyniosła niejednoznaczne wyniki. Jednak przy bliższym przyjrzeniu się fotografii można zauważyć pewną charakterystykę: nienaturalny wzór dywanu, brak spójnych cieni czy nieczytelne napisy na grzbietach książek.

Drugie zdjęcie przedstawia dwie osoby leżące w łóżku, które również przypominają sylwetki Trumpa i Clintona. Według analizy, obraz po raz pierwszy pojawił się w sieci w grudniu 2025 roku, jednak jego autor pozostaje nieznany. Obecność znaku wodnego SynthID wskazuje jednak, że obraz został wygenerowany lub zmodyfikowany z wykorzystaniem narzędzi AI firmy Google.

Dodatkowo, widoczne są zniekształcenia w ułożeniu elementów sceny oraz niespójności w przedstawieniu postaci. W konsekwencji Snopes uznało, że fotografia została stworzona lub przynajmniej zmodyfikowana przy użyciu AI.

W świecie, w którym wszystko może być prawdą

Wraz z powolnym ujawnianiem kolejnych informacji coraz trudniej jednoznacznie określić, co jest autentyczne, a co stworzone przez AI. Każda kolejna publikacja odsłania nowe elementy historii. Wiadomo, że na wyspie wydarzały się rzeczy skandaliczne i przerażające, jednak faktyczna skala tych wydarzeń jest nadal nieznana.

W kontekście wyspy Epsteina, gdzie wiele faktów nadal pozostaje niewyjaśnionych, powstaje duże pole dla wyobraźni, którą dziś łatwo „przelać na obraz” za pomocą deepfake i szybko rozpowszechnić w internecie.

Jeden z użytkowników Instagrama napisał

„Najnowsze wieści o Aktach Epsteina wydają się mniej newsami, a bardziej powolnym, narastającym obnażaniem samej władzy. Każdy dokument odsłania kolejną warstwę: nazwiska, powiązania, loty, przypomnienia o spotkaniach (…). To, co kiedyś brzmiało jak plotki o spisku, teraz jest wpisane w akta sądowe i zeznania. Ale oto prawdziwe pytanie: jak głęboko to sięga? Akta nie tylko rozdrapują rany, ale i podważają narracje, reputację i ciche systemy ochrony elit”.

W tej sytuacji obserwujący sytuacją nie mają kompletnie pojęcia co jest prawdą, a co manipulacją. Zwłaszcza, że po ujawnianych dokumentach można spodziewać się niemal wszystkiego.

Sprawdzanie autentyczności takich treści też jest niewiarygodne, bo analizatory materiałów generowanych przez AI dostarczają niespóje wyniki.

W tej kwestii warto również zwrócić uwagę na różnice między platformami. Na X użytkownicy mogą dodawać kontekst do postów i informować innych, czy na przykład zdjęcie jest rzeczywiste. Ma to wpływ na większą przejrzystość informacji. Co ciekawe jednak, sam system Grok zapytany o autentyczność zdjęcia przedstawiającego Clintona i Hawkinga z lalkami odpowiedział, że jest ono prawdziwe (mimo że według Snopes to Grok miał je wygenerować). Na Instagramie natomiast podobne mechanizmy fact-checkingu nie istnieją.

Autor. https://x.com/xx17965797n/status/2030056961845137881?s=46&t=vg_xpukTvEYtfg_QcXTzuQ , https://x.com/mooncastle02/status/2030157000127172961?s=46&t=vg_xpukTvEYtfg_QcXTzuQ , https://x.com/reneefit97/status/2029985657108766944?s=46&t=vg_xpukTvEYtfg_QcXTzuQ

Interpretacje roli AI w obiegu informacji

W związku z chaosem informacyjnym, w przestrzeni internetowej zaczęło pojawiać się coraz więcej teorii sugerujących, że tego typu obrazy mogą być celowo rozpowszechniane. Według części użytkowników, zdjęcia generowane przez sztuczną inteligencję mają służyć celowemu zamazywnaiu granicy między tym, co autentyczne, a tym, co fałszywe.

W komentarzach pojawiają się więc sugestie, że rozpowszechnianie takich materiałów ma osłabić wiarygodność ewentualnych autentycznych dowodów związanych ze sprawą wyspy Epsteina. Niektórzy idą dalej, sugerując, że gwałtowny rozwój generatywnej AI nieprzypadkowo zbiegł się w czasie z publikacją kolejnych dokumentów dotyczących tej sprawy.

Część użytkowników twierdzi również, że może to być próba odwrócenia uwagi opinii publicznej od innych wydarzeń politycznych.

Tego typu interpretacje pokazują, jak łatwo brak jednoznacznych informacji sprzyja powstawaniu i rozpowszechnianiu nieprawdopodobnych teorii.

Autor. źródło nieznane , https://www.instagram.com/p/DVwHo2DDG9c/?igsh=a3c0ODRyYjNlcjBh

Serwis CyberDefence24.pl otrzymał tytuł #DigitalEUAmbassador (Ambasadora polityki cyfrowej UE). Jeśli są sprawy, które Was nurtują; pytania, na które nie znacie odpowiedzi; tematy, o których trzeba napisać – zapraszamy do kontaktu. Piszcie do nas na: [email protected].

Krajowy system e-Faktur - co musisz wiedzieć o KSEF?

Materiał sponsorowany