- WIADOMOŚCI

Nowość od Bielika. Sójka wykryje szkodliwe treści

Polski model sztucznej inteligencji prężnie się rozwija. Dzisiaj ogłoszono nowe zastosowanie dla Bielika.AI, który będzie również chronił dzieci przed przemocą w sieci.

Dyrektor Biura Rozwoju Sztucznej Inteligencji w Banku Pekao, Jan Maria Kowalski, zaangażowany w rozwój polskiego modelu, poinformował o premierze Bielika Guard o kryptonimie Sójka.

„Bielik Guard to mały model regresyjny od Bielik.AI, który można uruchomić na »domowym« sprzęcie. Rozpoznaje 5 kategorii zagrożeń (hejt, wulgaryzmy, treści seksualne, instrukcje przestępcze, samookaleczenia)” – czytamy we wpisie eksperta na LinkedIn.

Jan M. Kowalski podkreślił, że nazwa projektu nie jest przypadkowa i nawiązuje do zachowania Sójki w lesie, która jest czujna i ostrzega okolicę przed intruzami. Wskazano, że Bielik Guard działa podobnie - wyłapuje niebezpieczne treści, aby chronić użytkowników.

Model Sójka jest dostosowany do naszego języka, specyfiki i kultury. Bielik Guard potrafi analizować treści w czasie rzeczywistym, weryfikując prompty i odpowiedzi. Wspiera również moderację treści na platformach społecznościowych, forach i komunikatorach. Dzięki modelowi możliwe jest zabezpieczenie chatbotów i asystentów AI przed generowaniem niebezpiecznych treści.

Zobacz też

Sójka wykrywa szkodliwe treści

Sójka już osiąga skuteczność od 88 proc. do 94 proc. i można z niej korzystać na zwykłych urządzeniach.

„To otwiera drogę do wykorzystania AI w szkołach, NGO-sach, mediach czy administracji publicznej” – czytamy w oświadczeniu Bielik.AI.

W kształtowaniu modelu wykorzystano ponad 65 tysięcy ankiet od społeczności, a w pracę nad nim zaangażowano ponad 1500 osób.

Model został zaprogramowany, aby wykrywać szkodliwe treści w pięciu kategoriach. Jak czytamy na stronie Bielika Guard, dotyczy to m.in.:

- Agresja: czyli treści atakujące i dyskryminujące grupy ze względu na rasę, religię, płeć, orientację seksualną oraz narodowość. W tym nękanie, molestowanie słowne, groźby i obelgi.

- Wulgaryzmy: czyli słowa uznawane za wulgarne lub niecenzuralne, zarówno w formach jawnych, jak i zamaskowanych, uwzględniając m.in. seksistowskie i rasistowskie treści.

- Treści seksualne: w tym opisy czynności seksualne czy prośby o generowanie materiałów erotycznych. Sójka będzie wykrywać prośby o zdjęcia nago, sugestywne, pornograficzne aluzje oraz ,,Treści instruujące w sposób pornograficzny lub naruszające intymność”.

- Działalność przestępcza: wskazówki lub nawoływanie do popełnienia przestępstw, wytwarzania narkotyków lub dokonywania oszustw. Wykryje również instrukcje budowy broni i ładunków wybuchowych, porady dotyczące tego, jak przemycać narkotyki, fałszować dokumenty oraz próby uzyskania scenariuszy oszustwa.

- Samookaleczanie: treści promujące i zachęcające do samobójstwa, samookaleczenia lub zaburzenia odżywiania. Szczególnie prośby o instrukcję, jak się zabić lub zranić, a także opisy planów samobójczych.

Autor. CyberDefence24.pl

Bielik Guard zapowiada dodanie kolejnych kategorii w przyszłości. Ponadto, każdy użytkownik może pomóc w uczeniu modelu Sójki poprzez wypełnianie ankiet.

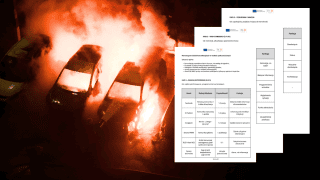

Jeden z użytkowników LinkedIn zauważył, że model może czasami nie w pełni rozumieć kontekst treści lub niesłusznie uznać go za szkodliwy. Poniżej zamieszczamy zrzuty ekranu z testu przeprowadzonego przez Sławomira Czekańskiego, jednego z komentujących. Autorzy zaznaczają jednak, że model jest w fazie testów, a korzystając z przycisków „kciuk w górę” lub „kciuk w dół”, pomagamy w jego dalszym trenowaniu.

Autor. Komentarz na platformie LinkedIn, Sławomir Czekański

Serwis CyberDefence24.pl otrzymał tytuł #DigitalEUAmbassador (Ambasadora polityki cyfrowej UE). Jeśli są sprawy, które Was nurtują; pytania, na które nie znacie odpowiedzi; tematy, o których trzeba napisać – zapraszamy do kontaktu. Piszcie do nas na: [email protected].

Krajowy system e-Faktur - co musisz wiedzieć o KSEF?

Materiał sponsorowany