- WIADOMOŚCI

Sztuczna inteligencja w mainstreamie. ChatGPT bije rekordy popularności, podobnie jak Lensa AI

Model ChatGPT opiera się na interakcji z ludźmi; polega na dialogu i zadawaniu pytań sztucznej inteligencji. W ostatnich dniach bije rekordy popularności – coraz więcej użytkowników chce sprawdzić, czy AI popełni błąd, albo jak odpowie na ich podchwytliwe pytania. Dodatkowo hitem jest aplikacja Lensa AI, która przerabia wgrane przez użytkownika selfie w awatary. Czy to oznacza, że SI wchodzi do mainstreamu?

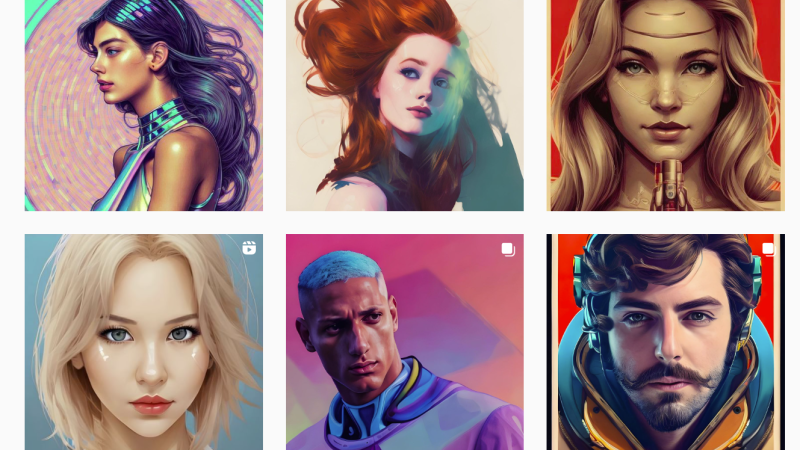

Autor. Instagram/ Lensa AI

OpenAI to firma, która zajmuje się badaniami i rozwojem modeli sztucznej inteligencji. Na swojej stronie internetowej twierdzi, że jej misją jest „zapewnienie, aby sztuczna inteligencja przynosiła korzyści całej ludzkości”.

Badacze wyszkolili model AI o nazwie ChatGPT, który wchodzi w interakcje z człowiekiem stawiającym jej pytania. Odrzuca niewłaściwe prośby, przyznaje się do błędów, czy też uzasadnia – wydawałoby się – nawet dość kontrowersyjne kwestie. Przetestowano ją na przykład w procesie rekrutacji, tworzeniu poezji czy udzielaniu porad konsumenckich.

Od kilku dni hasztag #ChatGPT znajduje się w trendach, na przykład na platformie Twitter, a jak zwraca uwagę serwis The Verge – model ten dowodzi, że „sztuczna inteligencja jest wreszcie w głównym nurcie”.

Dla porównania: ChatGPT przekroczył liczbę ponad milion użytkowników w ciągu zaledwie 5 dni, co Netflixowi zajęło 41 miesięcy, Facebookowi – 10 miesięcy, a Instagramowi – 2,5 miesiąca.

ChatGPT has crossed 1M+ users in just 5 days.

— Aleksandr Volodarsky 🇺🇦 (@volodarik) December 8, 2022

To compare, it took Netflix 41 months, FB - 10 months, and Instagram - 2.5 months.

But many haven’t yet realized its full potential.

Here are the 10 mindblowing things you can do using it right now:

W sieci pojawiły się przykłady osób, który używały tego modelu AI do pisania kodu, pisania esejów na studia, szkicowania postów na blogach czy przygotowywania raportów do pracy. Choć wciąż jej działanie nie jest idealne, to z relacji użytkowników można wyciągnąć jeden wniosek: są zaskoczeni, że sztuczna inteligencja może mieć tak duży wpływ na nasze działanie w sieci (choć naukowcy mówili o tym od kilkudziesięciu lat).

Aplikacje do przerabiania zdjęć

W Polsce dość dużą dynamiką, jeśli chodzi o wzrost liczby użytkowników, cieszą się także aplikacje do przerabiania zdjęć. Generatory obrazów AI budzą zainteresowanie nawet osób niezwiązanych z technologiami. Są to m.in. Midjourney AI (generator obrazów tworzący je w oparciu o słowa), Stable Diffusion (kreowanie obrazów w oparciu o tekst), Lensa AI (płatna aplikacja, która po wgraniu 10-20 swoich selfie generuje „upiększone” przez algorytm zdjęcia w formie awatarów) czy narzędzie AI Canva, które przetwarza tekst w obraz. Za wszystkim stoją właśnie modele sztucznej inteligencji.

Poza możliwościami, jakie niesie ze sobą ich użytkowanie, na razie oczywiście cicho o zagrożeniach, których nie brakuje: począwszy od zbierania i przetwarzania danych o użytkownikach, tak chętnie z nich rezygnujących; po wyzwania dla uczelni, które mogą zostać zalane esejami napisanymi przez AI.

Do tego dochodzą takie wyzwania, jak uprzedzenia na tle politycznym (dla przykładu jeden z użytkowników sprawdził czy ChatGPT ma poglądy i rezultatem jego testu był wynik, że owszem ma: lewicowo-liberalne); rasowym, językowym, odróżnienia prawdy od fikcji, czy praw autorskich do wygenerowanego obrazu.

The Verge zwraca uwagę , że AI posiada „ukryte możliwości” - to jest umiejętności i zdolności ukryte w systemach, których naukowcy nawet nie zaczęli jeszcze badać.

„Dzisiejsze modele są o wiele bardziej wydajne, niż nam się wydaje, a dostępne techniki ich eksploracji są bardzo młodzieńcze” – zwraca uwagę ekspert ds. polityki sztucznej inteligencji, Jack Clark, cytowany przez redakcję. „A co z wszystkimi możliwościami, o których nie wiemy, ponieważ nie pomyśleliśmy o ich przetestowaniu?”

Serwis CyberDefence24.pl otrzymał tytuł #DigitalEUAmbassador (Ambasadora polityki cyfrowej UE). Jeśli są sprawy, które Was nurtują; pytania, na które nie znacie odpowiedzi; tematy, o których trzeba napisać – zapraszamy do kontaktu. Piszcie do nas na: [email protected].

Krajowy system e-Faktur - co musisz wiedzieć o KSEF?

Materiał sponsorowany