- WIADOMOŚCI

Amazon wykorzystuje nasze emocje, aby przekonać nas do wpuszczenia robotów do domu

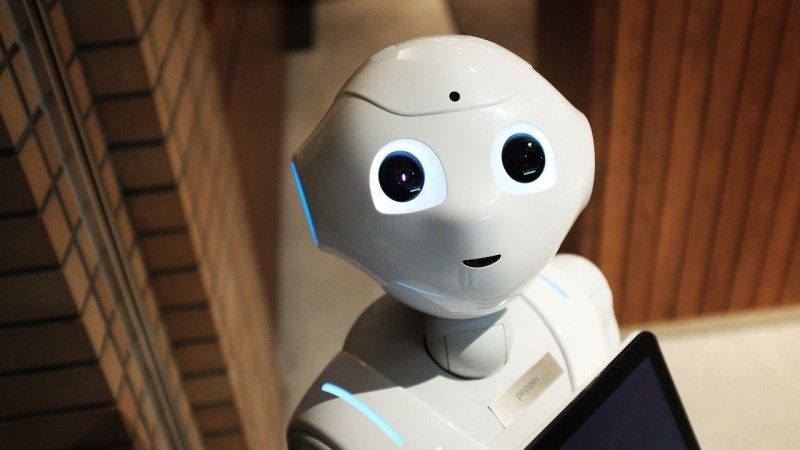

Jako ludzie jesteśmy skłonni niemal natychmiast empatyzować ze wszystkim, co przypomina dzieci lub po prostu wyposażone jest w duże oczy i przemawia do nas miłym głosem. Producenci robotów, a zwłaszcza Amazon, wiedzą doskonale, że tyle właśnie wystarczy, by chwycić nas za serce i skłonić do wpuszczenia pod swój dach robotów – nawet tych, które śledzą każdy ruch użytkownika, jak najnowszy wynalazek tego koncernu – robot Astro.

Pozornie absurdalnie brzmiąca teza o tym, jakoby ludzie zdolni byli odczuwać emocje względem robotów, czy innych urządzeń elektronicznych, jest uwiarygadniana od lat przez producentów rozmaitych gadżetów. Wystarczy przypomnieć sobie słynne lalki Baby Born, wyposażone w prosty system elektroniczny pozwalający na „jedzenie” czy „płacz”, które dla dzieci były na tyle przekonujące, że wzruszały je i budziły w nich opiekuńcze uczucia, względem plastikowego bobasa.

Innym dobrym przykładem były popularne na przełomie lat 90. i dwutysięcznych - futrzaste, zbliżone swoim wyglądem do słynnych filmowych gremlinów (w nieszkodliwej formie, przed kontaktem z wodą) - zabawki Furby, które miały wielkie oczy i potrafiły nawiązywać kontakt z posiadaczem, m.in. rozpaczając, gdy były zbyt długo pozostawione w samotności. Kto z nas nie czuł wyrzutów sumienia, gdy zaniedbał swoje wirtualne zwierzątko złożone z kilkunastu pikseli w erze, gdy światem rządziła moda na jajka Tamagotchi?

Emocje to klucz do naszych serc i domów

Para dużych oczu, niewielkie „ciało”, miły wygląd to klucz, który pozwala robotom otworzyć drzwi do serc użytkowników i do ich domów. Wykorzystała to m.in. firma Sony, która najpierw stworzyła roboty idealnie odwzorowujące wygląd przemiłych piesków Aibo, a następnie przekonała ludzi, by pokochali je tak bardzo, aby kupować dla nich drogie, firmowe akcesoria, a nawet opłakiwać po ich „śmierci” (gdy robotyczne pupile w sposób nieodwracalny się zepsuły).

Astro – nowy robot Amazona, który kosztuje 999 dolarów i obecnie dostępny jest jedynie na zaproszenie, dla wybranych konsumentów, powiela ten wzorzec. Jest niewielki, a jego górna część to „główka” z parą dużych, wpatrzonych w użytkownika oczu, które wyrażają niewinność, naiwność i bezradność. Urządzenie, które ma służyć jako „elektroniczna pokojówka”, wykonywać proste czynności domowe takie, jak przynoszenie określonych przedmiotów z innego pomieszczenia prosto do rąk użytkownika, a także patrolować nieruchomość podczas jego nieobecności, to jednak maszyna naszpikowana funkcjami, które pozwalają na gromadzenie ogromnej ilości danych na temat jej właściciela.

Astro nie tylko mapuje pomieszczenia, po których się porusza, ale także zapisuje wizerunek i próbki głosu właściwie każdej osoby, która znajdzie się w polu widzenia robota – oczywiście po to, by sprawnie wykonywać zadania związane z funkcjami bezpieczeństwa, które ma zapewniać swoim użytkownikom. Według niektórych osób zaangażowanych w pracę nad urządzeniem, robot jest na tyle niedopracowany, że nie powinien w ogóle trafić na rynek. O Astro, a także wątpliwościach dotyczących tego robota, pisaliśmy już w serwisie CyberDefence24.pl tutaj.

Czy robota można skrzywdzić?

Obecnie coraz więcej robotów to tzw. roboty społeczne, projektowane z myślą o tym, by dostarczać człowiekowi towarzystwa, asystować mu podczas codziennych zadań – np. zakupów, podstawowych czynności opiekuńczych, a także w edukacji. Wiele z tych urządzeń ma postać zbliżoną do zwierzęcej (np. Paro – robotyczna foka zaprojektowana, by towarzyszyć osobom mieszkających w placówkach opieki geriatrycznej, czy wspomniany już wcześniej piesek Aibo).

Inne roboty przypominają człowieka – jak budząca grozę i zdumienie Sophia (w ramach fenomenu psychologicznego zwanego doliną niesamowitości, o którym w swojej książce „Wiek paradoksów” pisała Natalia Hatalska).

To, co je łączy, to fakt, że wszystkie budzą w ludziach skrajne emocje. Najlepiej ukazał to przeprowadzony z wykorzystaniem robota Pleo (przypominającego dinozaura) eksperyment, w ramach którego uczestników proszono, by się nad nim znęcali i torturowali. Wiele osób odmówiło, argumentując to tym, że nie chcą, aby maszyna o wyglądzie miłego gada odczuwała ból i cierpienie.

Inni jednak nie mają problemu z „krzywdzeniem” robotów – w przeprowadzonych przez japońskich naukowców badaniach wykazano, że dzieci pod nieobecność rodziców mają tendencję do wyzywania robotów działających na terenie np. centrów handlowych, a także ich kopania i popychania.

Czy powstaną regulacje chroniące roboty przed aktami wandalizmu?

Kopanie robotów, ich niszczenie, a także „krzywdzenie” w inny sposób, to nie tylko problem wandalizmu, który jest oczywisty – wszak uszkodzenie robota to destrukcja czyjejś własności. To również problem etyczny, jak twierdzą coraz popularniejsze grupy aktywistów chcących nadać robotom prawa, których celem ma być ich ochrona – na wzór praw zwierząt czy praw człowieka.

Idea ta najwięcej zwolenników ma w Korei Południowej, gdzie robotów społecznych oprócz Japonii obecnie jest najwięcej. „Roboty w przyszłości będą zdolne do odczuwania swoich własnych stanów wewnętrznych, motywacji i emocji” – argumentuje profesor Jog-Hwan Kim, jeden z głównych południowo-koreańskich ekspertów od robotyki. „Będziemy w przyszłości musieli traktować je tak, jak traktujemy swoje zwierzęta domowe” – dodaje.

Plany uregulowania statusu robotów są również na agendzie Unii Europejskiej, która rozpatruje tę kwestię zarówno pod względem etyki samych urządzeń robotycznych, ale także roli, jaką w życiu Europejczyków odgrywać ma sztuczna inteligencja.

Chcemy być także bliżej Państwa – czytelników. Dlatego, jeśli są sprawy, które Was nurtują; pytania, na które nie znacie odpowiedzi; tematy, o których trzeba napisać – zapraszamy do kontaktu. Piszcie do nas na: [email protected]. Przyszłość przynosi zmiany. Wprowadzamy je pod hasłem #CyberIsFuture.

Serwis CyberDefence24.pl otrzymał tytuł #DigitalEUAmbassador (Ambasadora polityki cyfrowej UE). Jeśli są sprawy, które Was nurtują; pytania, na które nie znacie odpowiedzi; tematy, o których trzeba napisać – zapraszamy do kontaktu. Piszcie do nas na: [email protected].

Krajowy system e-Faktur - co musisz wiedzieć o KSEF?

Materiał sponsorowany