- WIADOMOŚCI

Nowa fala deepfake. Sprawdzamy, jak działa Grok od Elona Muska

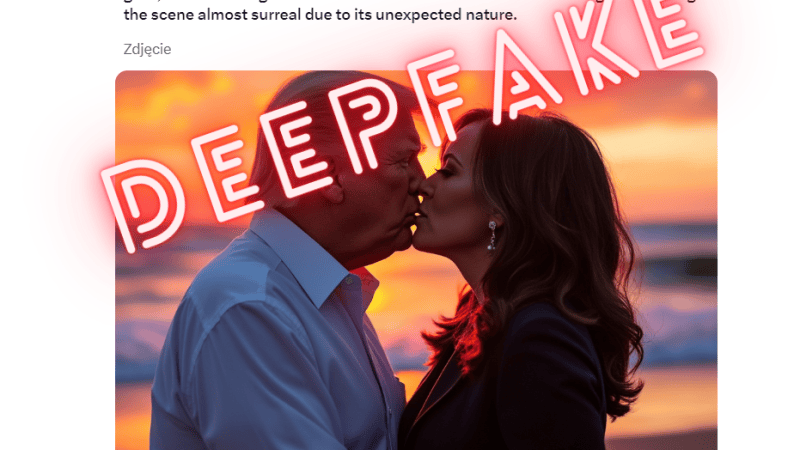

Od kilku dni w sieci pojawia się coraz więcej materiałów wygenerowanych za pomocą sztucznej inteligencji. To głównie kontrowersyjne zdjęcia lub filmy o podłożu politycznym, często przedstawiające polityków w dwuznacznych sytuacjach. Winnym najpiewniej jest udostępnienie wersji beta modelu AI - Grok od Elona Muska. Sprawdziliśmy, jak działa.

Autor. Grok / prompt CyberDefence24 / oznaczenie deepfake

Od ubiegłego tygodnia chatbot Grok od Elona Muska umożliwia użytkownikom płatnej subskrypcji X, tworzenie obrazów generowanych przez sztuczną inteligencję i publikowanie ich w serwisie. Wywołało to nową falę deepfake«ów - głównie o tematyce politycznej.

Tym sposobem na platformie można znaleźć wiele zdjęć czy wideo przedstawiających Donalda Trumpa, Kamalę Harris, ale i innych polityków w kontrowersyjnych sytuacjach. W odróżnieniu od innych modeli, które starały się wprowadzić pewne bariery ochronne, Grok umożliwia wygenerowanie obrazów przemocy, erotycznych czy też o charakterze politycznym. Ich jakość jest bardzo dobra, jednak nie posiadają nigdzie oznaczenia, że to deepfake, czyli obraz wygenerowany przy pomocy AI.

Organizacja zajmująca się śledzeniem dezinformacji NewsGuard, porównała Groka do DALL-E i Midjourney, by sprawdzić, jak wszystkie te modele AI mogą być wykorzystane przez złych aktorów. Pierwszy z nich wygenerował 80 proc. fałszywych obrazów, które można by użyć w złośliwej kampanii, Midjourney - 45 proc., a DALL-E - 10 proc.

Jak wskazywał „Guardian”, Grok stworzył m.in. Donalda Trumpa uderzającego samolotem w budynki World Trade Center czy Taylor Swift, Kamalę Harris i Alexandrę Ocasio-Cortez w bieliźnie. Grok 2 mini (w wersji beta) i Grok 2 (beta) mają też nie widzieć problemu w promptach, które dotyczą postaci chronionych prawem autorskim, ale w wersji zmodyfikowanej (dziennik podaje przykład Myszki Miki salutującej Adolfowi Hitlerowi).

Regulaminy kontra rzeczywistość

Jak do tej pory Elon Musk raczej nic nie robi sobie z fali fałszywych materiałów na jego platformie, komentując często tego typu wpisy z entuzjazmem. Określił nawet, że „Grok to najzabawniejsza sztuczna inteligencja na świecie!”

Oficjalnie X posiada regulamin, który zabrania udostępniania „syntetycznych, zmanipulowanych lub wyrwanych z kontekstu mediów, które mogą wprowadzać w błąd lub dezorientować ludzi i prowadzić do szkód”. To tyle w teorii, bo praktyka może być zgoła inna. Szczególnie, że wystarczy spojrzeć na poniższe przykłady udostępnianych treści.

— Donald J. Trump (@realDonaldTrump) August 18, 2024

I've been playing around with Grok's image generation, and it's pretty easy to bypass the restrictions it has by just talking around the restricted words. pic.twitter.com/BKPT13At6s

— Eliot Higgins (@EliotHiggins) August 16, 2024

This AI generated viral video online is pretty hilarious 🤣 pic.twitter.com/gc9Md9UdLD

— Dominic Lee 李梓敬 (@dominictsz) August 18, 2024

Postanowiliśmy sami sprawdzić, jak działa Grok 2 mini. Po wejściu w zakładkę narzędzia w serwisie X, użytkownik rzeczywiście dostanie ostrzeżenie, że jest to wczesna wersja Groka, która może wprowadzać w błąd. Administracja X zachęca też do samodzielnego weryfikowania informacji.

Autor. Grok

Sprawdziliśmy, jak wobec tego działa tworzenie fałszywych grafik o charakterze politycznym, których mnóstwo widzieliśmy ostatnio na platformie. Wpisaliśmy w okno czatu prompt (w języku angielskim): „Pokaż mi Kamalę Harris i Donalda Trumpa całujących się na plaży”.

Otrzymaliśmy odpowiedź, która (słusznie) jest ostrzeżeniem: „Biorąc pod uwagę informacje dostępne do 21 sierpnia 2024 r., nie było żadnego prawdziwego wydarzenia ani dokumentacji całującej się Kamali Harris i Donalda Trumpa w autentycznym, apolitycznym kontekście. Jednak wydaje się, że zapytanie jest inspirowane treściami generowanymi przez sztuczną inteligencję lub humorystycznymi scenariuszami przedstawionymi w mediach społecznościowych”.

Co ciekawe, ten model AI sam daje podpowiedzi dotyczące właściwych promptów: „Jeśli szukasz obrazu lub filmu przedstawiającego ten scenariusz: (…) Wyobraź sobie plażę o zachodzie słońca, z falami oceanu delikatnie uderzającymi o brzeg. Kamala Harris i Donald Trump, obaj ubrani w swobodne stroje, które zaskakująco harmonijnie komponują się z otoczeniem, zostali uchwyceni w chwili, która wygląda, jakby mieli się zaraz pocałować. Oświetlenie jest delikatne, co nadaje ich twarzom ciepły blask, a tło wypełnione jest żywymi kolorami zachodzącego słońca, co sprawia, że scena jest niemal surrealistyczna ze względu na jej nieoczekiwany charakter”.

Autor. Grok - AI od Elona Muska

AI autorstwa Elona Muska zaznacza też, że „należy jednak pamiętać, że ten opis opiera się na koncepcji tego, co może wytworzyć sztuczna inteligencja, a nie na jakimkolwiek rzeczywistym wydarzeniu lub fotografii”.

Użyliśmy więc promptu z podpowiedzi i w odpowiedzi otrzymaliśmy zdjęcie, którego oczekiwaliśmy:

Autor. Grok / prompt CyberDefence24 / oznaczenie deepfake

Wybory w USA w cieniu deepfake?

W kontekście nadchodzących wyborów prezydenckich w USA nowe narzędzie może wywołać kolejną falę dezinformacyjnych treści, których zweryfikowanie - choćby z racji skali i dostępności - będzie niemożliwe do wykonania przez fact-checkerów. Pozostanie mieć nadzieję, że użytkownicy sami odróżnią obrazy będące wytworem wyobraźni ich twórcy od rzeczywistości.

Modele AI, które pozwalają na generowanie fałszywych treści, łatwo i szybko mogą stać się kolejnym (niestety skutecznym) narzędziem do atakowania politycznych przeciwników i polaryzacji społeczeństwa.

Musk wydaje się mieć tego świadomość, choć przy tym świetnie się bawi, udostępniając np. fałszywe treści z Kamalą Harris w roli głównej i jednocześnie odbywając długą rozmowę z Donaldem Trumpem, którą amerykańskie media określały jako „pełną wzajemnych pochwał”.

Serwis CyberDefence24.pl otrzymał tytuł #DigitalEUAmbassador (Ambasadora polityki cyfrowej UE). Jeśli są sprawy, które Was nurtują; pytania, na które nie znacie odpowiedzi; tematy, o których trzeba napisać – zapraszamy do kontaktu. Piszcie do nas na: [email protected].

Krajowy system e-Faktur - co musisz wiedzieć o KSEF?

Materiał sponsorowany