- WIADOMOŚCI

- WYWIADY

Bosak: problem cenzury treści to tylko „wierzchołek góry lodowej”

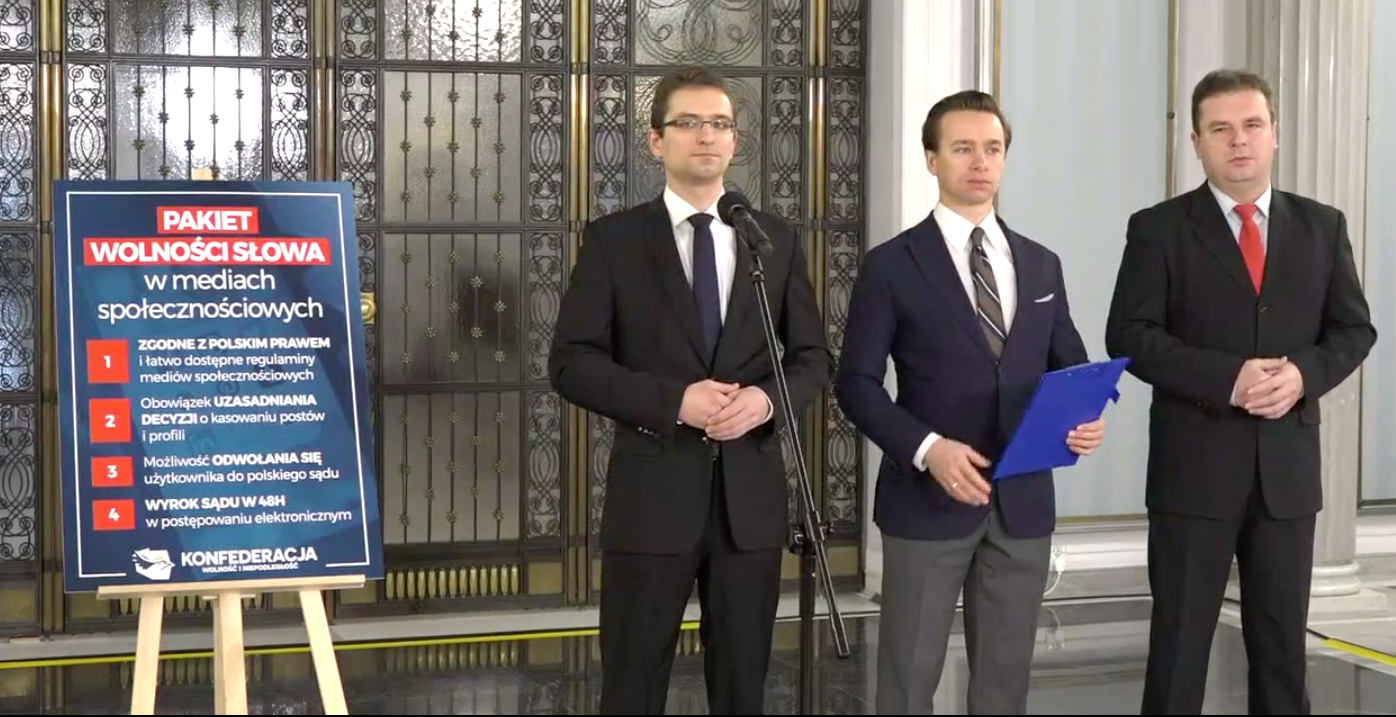

”Nie jest akceptowalna sytuacja, że obywatele innych państw albo osoby przebywające za granicą podejmowały decyzje w sprawie swobód wypowiedzi Polaków” - stwierdził Krzysztof Bosak, współzałożyciel Konfederacji, z którym rozmawialiśmy na temat zaproponowanych przez partię regulacji mediów społecznościowych. W wywiadzie poruszyliśmy również temat ataku na Kapitol oraz przyszłości platform społecznościowych.

13 stycznia ogłosili Państwo „4 zasady, które mają zagwarantować swobodę wypowiedzi dla polskich obywateli”. Jak dotychczas platformy społecznościowe jako prywatne podmioty, opierały się na swoich regulaminach i politykach, które każdy użytkownik musiał zaakceptować chcąc korzystać z serwisu. Państwa propozycja mówi o opieraniu się jedynie na polskim prawie. Jaki jest Państwa stosunek do kwestii regulaminów tych platform? Czy w Państwa opinii platformy społecznościowe, oprócz konieczności respektowania prawa, nie powinny mieć jednak prawa do stosowania swoich własnych „przepisów porządkowych”?

Odesłanie do przepisów polskiego prawa dotyczy tylko jednej pośród wielu kwestii, które są niezbędne do uregulowania w procesie funkcjonowania platform społecznościowych. Sprawą najważniejszą jest wyznaczenie granicy wolności słowa, czyli określenie treści, które są tymi zakazanymi oraz tymi dozwolonymi przez prawo. Natomiast regulaminy różnego rodzaju platform społecznościowych, czy szerzej usług internetowych, z reguły zajmują się znacznie szerszą grupą problemów. Polskie prawodawstwo określa problemy, którymi może i powinien zajmować się regulamin – mówi o tym ustawa o świadczeniu usług drogą elektroniczną, która wręcz wymaga tworzenia tego typu dokumentów. Regulaminy te same w sobie pełnią dobrą rolę - pod warunkiem oczywiście, że mają właściwe, precyzyjne brzmienie i właściwe zamierzenie, czyli mają na celu ułatwianie relacji pomiędzy dostawcą usługi elektronicznej, a jej użytkownikiem. Mogą i powinny one określać np. do jakich usług zobowiązuje się usługodawca, jak wygląda kwestia gospodarowania danymi osobowymi, jak pracuje algorytm platformy - bo to powinna być kwestia transparentna - jak wyglądają procedury ściągania treści, które prawnicy danej platformy oceniają jako bezprawne, oraz wskazywać na zasady odwołania się od decyzji platformy. To jest cała grupa procedur i działań, które powinny być przez regulamin przewidziane.

Natomiast rolą regulaminów nie jest wprowadzanie arbitralnej, bezprawnej i niezdefiniowanej w żadnych przepisach cenzury. Za każdym razem, gdy czytam wypowiedzi osób, które mówią, że przecież użytkownik zaakceptował regulamin platformy, dlaczego więc teraz się dziwi, gdy jest on stosowany, mam wrażenie, że nigdy ich nie czytali. W tych regulaminach z reguły nie ma żadnych precyzyjnych zapisów czyniących bezprawnymi treści, które później platformy usuwają. Można odnieść wrażenie, że są one rodzajem takiego ogólnego upoważnienia, aby na bieżąco i w dyskrecjonalny sposób platforma decydowała co jest prawomyślne, a co nie.

Przez fakt posiadania zbyt ogólnych postanowień, dających prawo wiążącej wykładni właściwie tylko jednej ze stron i reinterpretacji jej w nieskończoność mają charakter klauzul niedozwolonych. Właściwie do tego problemu platformy nigdy się nie odniosły.

Czy słusznie odniosłam wrażenie, że platformy społecznościowe - zgodnie z Państwa - propozycją miałyby zostać pozbawione prawa do usuwania treści, które w ich opinii naruszają wypracowane standardy społeczności? Czy całkowite pozbawienie możliwości decydowania o tym, co dozwolone, a co jest zakazane na określonych platform nie potęguje problemu?

Oczywiście, po to każda duża firma posiada działy prawne, aby prawnicy doradzający zarządowi firmy znali po pierwsze obwiązującą na danym rynku wykładnie prawa, a po drugie orzecznictwo sądów. Wiadomo, że granice wolności słowa w praktyce określane są poprzez spór o wykładnię obowiązujących przepisów. Spór ten odbywa się przed sądami, a przepisy są stopniowo doprecyzowywane w drodze kształtowania się orzecznictwa sądów i w ten sposób mogą być też poprawiane przez ustawodawcę.

Jeżeli mówimy o globalnej korporacji to nie jest wcale przesadnym oczekiwanie, że będzie ona posiadała dział prawny władający językiem polskim i znający orzecznictwo polskich sądów. I teraz jeśli chodzi o sam sposób usuwania z platform treści nielegalnych, to są dwa możliwe modele.

Pierwszy jest taki, że treści są zgłaszane do organów wymiaru sprawiedliwości danego państwa, następnie czeka się na rozstrzygnięcie - czy mają one charakter legalny czy nielegalny - i jeżeli to rozstrzygnięcie jest pozytywne, to oznacza, że te treści zostały uznane za nielegalne i wówczas są usuwane. Drugi schemat działania polega na tym, że jeżeli wewnętrzna ocena danego dostarczyciela usług wskazuje, że treści mają charakter nielegalny, to powinien on wysłać powiadomienie do odpowiednich organów i na podstawie własnej oceny zdjąć te treści. Następnie ta decyzja może zostać post factum poddana kontroli sądowej, administracyjnej lub innej, w zależności jaki był charakter naruszenia - ewentualnie zostać podtrzymana lub odwrócona. Ta druga procedura jest już znana w ramach funkcjonowania internetu w zakresie naruszeń praw autorskich i to nazywa się „notice and takedown” - uważamy, że jest ona bardziej efektywna.

To, co my chcemy dodać do tego modelu, to po pierwsze ograniczenie możliwości stosowania cenzury wyłącznie do treści rzeczywiście bezprawnych, a nie do treści, które komuś się nie podobają lub są negatywnie oceniane przez jakąś grupę, choć są legalne. Po drugie, chcemy dodać element sądowej oceny post factum i to oceny pilnej, czyli następującej najdalej w przeciągu kilku dni tak, żeby odwrócenie decyzji o ocenzurowaniu jakiegoś materiału miało charakter rzeczywistego przywrócenia tej treści. Jeżeli miałoby się to odbywać w zwykłej procedurze sądowej, która może potrwać nawet kilka lat, oczywiście nie miałoby to żadnego sensu. Tak jest w tej chwili przykładowo z częściowo martwymi przepisami prawa prasowego o publikacji sprostowania - jeżeli procesowanie się o publikację sprostowania może trwać nawet dwa lata, to wiadomo, że po tak długim czasie nie ma ono już najmniejszego znaczenia z punktu widzenia debaty publicznej. Dlatego też przepisy te muszą działać bardzo sprawnie.

Pewnym wzorcem jest dla nas proces w trybie wyborczym, który odbywa się w bardzo szybkim tempie i pozwala otrzymać rozstrzygnięcie wpływające bezpośrednio na debatę publiczną. Uważamy, że z uwagi na informatyzację platform społecznościowych również kontrola decyzji mogłaby odbywać się w formie sądu elektronicznego, bez żadnego fizycznego stawiennictwa stron i w drodze przyspieszonego, uproszczonego postępowania.

Przepisy prawa, które oczekujemy, że rząd wprowadzi są zbieżne z tymi, wstępnie przedstawianymi przez ministerstwo sprawiedliwości oraz z konkluzjami dyskusji na ten temat u Rzecznika Praw Obywatelskich w 2016 roku. Mają one bardzo przyczynkowy charakter, ponieważ nie odnoszą się do całej grupy problemów związanych z technologią działania platform społecznościowych, z gospodarowaniem danymi, nie dotyczą również problemów manipulowania debatą publiczną poprzez arbitralne modyfikacje algorytmu, które, jak już wiemy, mają charakter wzmocnienia negatywnych emocji społecznych.

Nasza propozycja nie dotyczy tych problemów, jednak również one powinny być przedmiotem zainteresowania opinii publicznej, ustawodawcy i regulatora. Nasz pomysł odnosi się wyłącznie do kontroli sądowej, konstytucyjnej swobody rozpowszechniania informacji i swobody prowadzenia debaty.

Państwa propozycja przewiduje tryb 48 godzinny, jeśli chodzi o pracę i wydanie wyroku przez sąd. Czy tak krótki okres czasu to nie jest jednak pomysł mało realny w naszych warunkach?

Oczywiście wdrożenie tego typu zmiany wymaga pewnego nakładu sił i środków. Ja sądzę, że to jest realne. Z informacji medialnych, które do nas docierają, a mamy je chociażby od byłych pracowników platform społecznościowych, decyzja o zdjęciu jednego materiału - o ile podejmuje ją człowiek - jest analizowana około kilkanaście sekund. To pobieżne zapoznanie się. Nas interesuje przede wszystkim poprawa tego standardu.

Nie jest potrzebne, aby sąd jakimś jednym materiałem, wypowiedzią czy wpisem zajmował się wiele godzin czy wiele dni. Tak naprawdę jest nam potrzebna dosyć szybka i sprawna ocena. To, w jaki sposób będzie się to odbywało, jest kwestią do rozpatrzenia dla sądu i dla ministra sprawiedliwości - natomiast w mojej ocenie przy dużej ilości takich spraw – będzie ich wiele - dość szybko sprawiłoby, że platformy społecznościowe podejmowałyby mniej decyzji o cenzurze różnego rodzaju materiałów.

Obecnie algorytmy platformy są ustawione w ten sposób, że wychwytują mnóstwo materiałów zgodnych z prawem jako materiały, które są niezgodne z ich wewnętrznymi regulaminami. Oczywiście przy poddaniu tego kontroli sądowej, natychmiast w pierwszych dniach funkcjonowania wyszłoby, że te materiały są legalne i nie powinny trafiać do kontroli sądowej. Jeśli któraś z platform nadużywałaby przepisów o usuwaniu materiałów i okazałoby się, że 99% poddanych kontroli sądowej treści byłoby zgodnych z prawem, być może należałoby przewidzieć jakieś kary dla tych platform, za coś co nazywamy „pieniactwem”, to znaczy przekazywaniem do kontroli sądowej spraw, które nie mają żadnych podstaw.

Stąd też nasz postulat, aby decyzje odbywające się wewnątrz platform podpisane były imieniem i nazwiskiem danego moderatora treści, jak i zawierały uzasadnienie - musi zostać wykonana praca po stronie platform. Skoro chcą one określone materiały ściągać, to konieczne jest aby uzasadniły, dlaczego uważają, że są one niezgodne z prawem, powołać się na określony przepis oraz muszą podpisać imieniem i nazwiskiem decyzję. Jestem za tym, aby osoby podejmujące takie działania były obywatelami polskimi, miały przygotowanie prawne i merytoryczne oraz władały językiem polskim. Nie jest akceptowalna sytuacja, że obywatele innych państw albo osoby przebywające za granicą podejmowały decyzje w sprawie swobód wypowiedzi Polaków. Przy odpowiedniej organizacji i przy zapewnieniu odpowiedniego personelu uważam, że taka kontrola jest możliwa - zarówno w ciągu 2 dni jak i 7 dni.

Wiemy też doskonale, że administracja sądowa po prostu dostosowuje się do terminów, które zostaną jej narzucone. Natomiast zwracam uwagę, że to zależy od tego, w jaki sposób zorganizujemy e-sąd do kontroli tych spraw, jakie wymogi narzucimy platformom. Media społecznościowe muszą zrozumieć, że nie mogą i nie powinny zgłaszać dziesiątek tysięcy spraw w ciągu miesiąca.

Dlaczego jednak przy problematyce zgłaszania tych spraw mówimy o platformach - przecież to użytkownicy, zgodnie z Państwa propozycją, będą zgłaszać potencjalne naruszenia do sądu?

Dlatego, że automatyzacja procedury kontroli sądowej zakłada, iż dokumentacja danej sprawy trafiałaby od platformy. Byłaby ona automatyczna - wraz z decyzją o zdjęciu danej treści, platforma miałaby obowiązek przedstawić uzasadnienie i przepis prawa, na podstawie którego dana treść zostaje ściągnięta. Następnie polski obywatel ma prawo odwołania się od tej treści, a jeśli platforma podtrzyma swoją decyzję, wówczas jest ona automatycznie przekazywana do kontroli sądowej i to sąd rozstrzygnie czy była ona zasadna. Od strony prawnej odwołuje się polski obywatel, jednak od strony cyfrowej dokumentacja danej sprawy pomiędzy danym e-sądem a samą platformą powinna wędrować drogą elektroniczną. Nie przewidujemy w tym procesie żadnego obiegu papierowej dokumentacji czy indywidualnej korespondencji pomiędzy obywatelem a e-sądem. Uważam, że należy stosować rozwiązania nowoczesne, jeśli chcemy zapanować nad otoczeniem informacyjnym i wtłoczyć je w ramy prawa i wyciągnąć spod arbitralnych polityk zagranicznych korporacji.

Niemniej jednak, jeśli weźmiemy pod uwagę fakt, że zakładają Państwo zaledwie 48-godzin, a w procesie od momentu zgłoszenia sprawy do sądu przez użytkownika niezbędna jest jeszcze reakcja platformy (czyli przesłanie uzasadnienia) oraz sama praca sądu (tj. rozpatrzenie sprawy) to czy tak krótki czas jest wystarczający?

Ja zakładam, że w momencie decyzji o usunięciu danej treści już zostało przygotowane uzasadnienie. Oczywiście to może być uzasadnienie krótkie, lakoniczne, jednak musi być wskazanie na podstawie jakiego przepisu polskiego prawa jest usuwana. Oczywiście, jeśli chodzi o implementację naszego pakietu na rzecz wolności słowa, jeżeli te kroki do pokonania wymagają, aby dodać jakiś etap, to oczywiście trzeba to zrobić. Chodzi o to, aby był wyznaczonych krótki, policzalny czas na samą kontrolę sądową. Aby ta procedura działała. Nie jest ważne czy będzie to 48 godzin czy 24, nawet czy to będzie 7 dni. Najważniejsze, aby ta kontrola sądowa była szybka i bezwzględna.

Uzasadnienie powinno być przygotowane przez platformę już na etapie podjęcia decyzji o usunięciu danej treści. To są właśnie nasze postulaty, aby decyzje podejmowane przez platformy były transparentne. To ma być procedura, która umożliwi nam zapanowanie nad odbywającą się obecnie w internecie „wolną amerykanką”, pozwalającą totalnie arbitralnie i chaotycznie cenzurować co popadnie.

W 2018 roku Ministerstwo Cyfryzacji ogłosiło, że porozumiało się z Facebookiem, czego wynikiem był punkt kontaktowy. Z danych przekazanych przez resort wynika, że skorzystało z niego zaledwie kilka tysięcy osób (od grudnia 2018 r. do września 2020 r. za pomocą usługi wpłynęły łącznie 3 244 zgłoszenia, z czego w 614 przypadkach Facebook odblokował treści lub konta, czyli około 19%) – z danych tych nie wynika, żebyśmy mieli wybitny problem z ograniczaniem wolności słowa na tej platformie. Jak Pan ocenia to rozwiązanie?

Ja nie uważam, że kilka tysięcy spraw, to jest mało. Jestem pewien, że większość ludzi, która jest cenzurowana w ogóle nie zgłasza się do tego punktu kontaktowego, ponieważ albo nie wie o jego istnieniu, nie wierzy w moc jego działania, albo też nie ma tyle cierpliwości, aby czekać na rozpatrzenie sprawy. Słyszałem też o osobach, które się tam zwracały i nie dostały żadnego pozytywnego rezultatu, przez co były zniechęcone i kolejny raz już tego nie zrobiły. Wiem też z rozmów nieoficjalnych, że siła oddziaływania tego punktu kontaktowego nie jest wcale duża.

Widać też, że procent treści przywracanych jest niewielki. Przykładowo profile środowisk narodowych, które zostały przez Facebooka po prostu zbanowane, nie zostały nigdy przywrócone, a zebrały one dziesiątki czy setki tysięcy użytkowników. Trzeba zdawać sobie sprawę, że Facebook każdego dnia usuwa mnóstwo materiałów i jest to również procedura zautomatyzowana.

To, że w tej chwili cenzura mediów społecznościowych w większym stopniu dotyka Amerykanów, czy generalnie sferę anglojęzyczną, niż nas Polaków czy to, że ujawnia się bardziej na Twitterze niż na Facebooku, nie oznacza, że nie powinniśmy reagować. Najgorsze w mechanizmach cenzorskich jest to, że w tym wszystkim nie widać zbyt wielu czytelnych reguł. Ta cenzura pojawia się, znika - czasem uderzy w kogoś małego, czasem w dużego - potem jest chwila ciszy, a następnie pojawia się manipulowanie algorytmami. Naprawdę różne narzędzia są stosowane, w różnym natężeniu i w różny sposób. Naszej czujności nie powinno usypiać to, że ta cenzura dotyka tylko niektórych lub jest stosowana w chaotyczny sposób - dlatego, że dotyka to bezpieczeństwa procesu wyborczego. Jeżeli nie mamy pewności, że treści, które są emitowane przez polskich obywateli rozchodzą się w jakiś równomierny, przewidywalny sposób, to w momencie, kiedy komunikacja polityczna zaczyna być zdominowana przez platformy społecznościowe, nie możemy mieć również pewności, że wybory będą przeprowadzone uczciwie.

Pragnę podkreślić, że problem cenzury treści, to tylko „wierzchołek góry lodowej” dlatego, że mamy jeszcze większy problem - brak transparentności stosowanych przez platformy społecznościowe algorytmów i nierównomierności prowadzenia polityki reklamowej. Dla przykładu Twitter odmówił przyjmowania zleceń reklamowych od organizacji pro-life - to w oczywisty sposób jest niesprawiedliwe, jeżeli od jednych opcji ideowych nie przyjmuje się płatnych reklam, a od innych tak. W odniesieniu do Facebooka, to wiele polskich polityków i ja również do nich należę, jest przekonanych, że sposób wyświetlania materiałów podczas ostatniej kampanii samorządowej do europarlamentu i parlamentu był taki, że algorytm nie działał w sposób równomierny dla wszystkich środowisk politycznych. Dało się zauważyć, że materiały, które tworzyły środowiska Konfederacji miały obniżone zasięgi, a z kolei te tworzone przez środowiska związane z lewicowo-liberalną opozycją były ponadprzeciętnie wysoko wyświetlane. W mojej ocenie nie jest to przypadek. Co więcej, mamy potwierdzone informacje ze Stanów Zjednoczonych, że administratorzy Facebooka prowadzą arbitralną politykę wyciszania jednych materiałów i nagłaśniania innych. Prowadzili ją w odniesieniu do konkretnych źródeł informacji, wyciszając te o profilu prawicowym a nagłaśniając te liberalne czy głównonurtowe. Jestem pewien, że podobne narzędzia były stosowane w Polsce.

Podczas prowadzenia kampanii wyborczej zetknęliśmy się z trudnościami związanymi z płatną emisją reklam, tzn. z zatwierdzaniem reklam. Facebook, będący obecnie największą platformą mającą bezpośredni wpływ na to, o czym dowie się i co zobaczy młodsza grupa wyborców, był platformą, która wprowadziła bardzo restrykcyjne procedury zatwierdzania reklam wyborczych i również zwlekał z tym zatwierdzeniem. Podobny problem mieliśmy z Googlem, który jest właścicielem YouTube’a. Niektóre nasze reklamy, odrzucano, pomimo że były zgodne z prawem. Zwracam uwagę, że cenzura treści umieszczanych informacyjnie, to tylko jeden problem, a obok tego mamy manipulowanie zasięgami i linkami do źródeł poprzez wygaszanie jednych a szersze wypuszczanie innych.

„Wolność słowa może kończyć się tylko tam, gdzie zaczyna się przestępstwo”. „Tym kto ocenia zgodność z prawem tego co jest publikowane, nie powinien być co do zasady wydawca (platforma społecznościowa – przyp. red.) tylko odpowiednie organy – organy państwa, organy ścigania oraz sądy są od tego, aby oceniać, czy coś jest zgodne z prawem” – powiedział mecenas Jacek Wilk podczas Państwa konferencji prasowej. Jednak w zeszłym tygodniu mogliśmy być świadkami tego, do czego doprowadził brak odpowiedniej reakcji na pojawiające się w mediach społecznościowych treści. Grupa zwolenników prezydenta Trumpa naruszyła zasady demokracji i wtargnęła do budynku Kapitolu, wcześniej organizując się w sieci i nawołując do siłowych rozwiązań. Na kim powinna zatem spoczywać odpowiedzialność za reagowanie na tego typu treści?

Moim zdaniem, jest ogromną manipulacją wskazywanie związku pomiędzy wtargnięciem na Kapitol a publikowanymi w mediach społecznościowymi treściami. Oczywiście część osób, które wdarło się do budynku mogło się zmawiać przez media społecznościowe, ale do tego celu mogły używać dowolnych komunikatorów internetowych. Moim zdaniem rola dużych platform społecznościowych, takich jak Twitter czy Facebook, była tutaj akurat marginalna. Co ważne, prezydent Trump, który został o wszystko obwiniony nie wzywał do przemocy i zajęcia Kapitolu - przeciwnie został ocenzurowany dokładnie w momencie, w którym wzywał do rozejścia i pokojowego zachowania się. Po trzecie, mieliśmy do czynienia z zamieszkami już od ponad roku, w których zginęło sporo osób - jednak nie wiodły nas one do refleksji o szkodliwej roli mediów społecznościowych. Nie rozumiem zatem dlaczego ten przykład, gdzie skala zamieszek była dużo mniejsza, nagle zmienia kierunek debaty publicznej. Uważam, że argument ten jest instrumentalnie wykorzystywany na rzecz ograniczenia swobody wypowiedzi, spacyfikowania ideowej i politycznej konkurencji w Stanach Zjednoczonych.

Warto też zwrócić uwagę, że wcześniej, kiedy w innych państwach dochodziło do niepokojów, rozruchów, masowych protestów czy nawet kolorowych rewolucji, to w mediach głównego nurtu panowało wręcz niezdrowe podniecenie, że ludzie zwołują się przez aplikacje internetowe - i było to postrzegane jako coś pozytywnego. Cały główny nurt oceniał to pozytywnie, ponieważ uważał, że są to ludzie, którzy stanęli przeciwko dyktaturze, a media społecznościowe, przysługujące się możliwości wszczęcia rewolucji, odegrały pozytywną rolę. W ślad za tym poszła Arabska Wiosna, podczas której komunikacja odbywała się w dużej mierze poprzez media społecznościowe, później były kolorowe rewolucje, Majdan, a w tym momencie mamy protesty na Białorusi, gdzie protestujący również zwołują się przez aplikacje internetowe. Proszę zwrócić uwagę, że w tych wszystkich przypadkach nie ma debaty medialnej nad tym, jak złą rolę odgrywają nowoczesne aplikacje informacyjne i media społecznościowe. Jeszcze raz to podkreślam, w mojej opinii jest to wyrazem ogromnej hipokryzji, że przykład ostatnich dni z Waszyngtonu jest tak wykorzystywany. Przyczyną wtargnięcia na Kapitol był brak ochrony. Gdyby był on prawidłowo ochraniany, żadna grupa sfrustrowanych demonstrantów nigdy nie wtargnęłaby do środka.

Media społecznościowe są platformami, gdzie ujawniają się i kształtują emocje, gdzie ludzie poznają wzajemnie swoje poglądy, wymieniają się informacjami i to się wszystko powinno odbywać w granicach prawa. Jeśli ktoś nawołuje do popełnienia przestępstwa, to, zgodnie z polskim prawem, jest to przestępstwo i ma prawo być usuniętym. Jeżeli ktoś nawołuje do nienawiści na tle jakiś podziałów społecznych, to również takie treści mają charakter nielegalny i mogą zostać usunięte. Natomiast jeśli ktoś wyraża swoje oceny polityczne, swoje niezadowolenie albo swój brak wiary w uczciwość przeprowadzonych wyborów, to są to treści legalne, dopuszczalne w każdej demokracji i towarzyszące nam także w Polsce po prawie każdych wyborach.

Po ostatnich wyborach prezydenckich wiele partii opozycyjnych, w tym np. Platforma Obywatelska, wyrażały swój krytycyzm co do sposobów przeprowadzenia kampanii wyborczej i nikt nie uważał tego za nawoływanie do przemocy. Podobnie wyborcy mają prawo wyrażać swoje niezadowolenie w związku z niejasnościami związanymi z liczeniem głosów i powinno to wszystko zostać wyjaśnione, a nie być traktowane jako nawoływanie do przestępstw i do przemocy. A ci, co w rzeczywistości nawołują do tej przemocy - to już kwestia prawa amerykańskiego czy oni sobie na to przyzwalają czy nie. Na gruncie polskich przepisów nie wolno nawoływać do przestępstw, przemocy i nienawiści. Akurat w tym aspekcie jest to bardzo jasne.

Media społecznościowe są wykorzystywane również do praktykowania bardzo negatywnych zjawisk – nękania, mowy nienawiści, obrażania, wyśmiewania czy nawoływania do popełniania przeróżnych przestępstw. Zapytam odrobinę przewrotnie - skoro Państwa propozycja ma na celu ograniczenie możliwości platformom usuwania czy ograniczania kont użytkowników, jak zatem Państwa projekt odnosi się do anonimowych kont w sieci, które prowadzą tego typu działalność? Problemu nie ma oczywiście z oficjalnymi profilami, jeśli jednak ograniczymy platformom możliwości reagowania na treści nieodpowiednie w miarę automatycznie i usuwania np. kont założonych wybitnie do „siania zamętu” czy obrażania, nie może to przynieść więcej szkód?

Moim zdaniem odpowiedź na to pytanie jest prosta - wypowiadanie się w Polsce w sposób anonimowy jest legalne. Sformułowanie swoich negatywnych opinii na różne tematy również. W związku z tym, nie ma powodu, aby tego zakazać. Jest kwestią naszej kultury społecznej, by kształtować debatę w sposób, w którym będzie opłacało się zabierać głos we właściwym tonie. Aby być słuchanym, budzić zainteresowanie konieczne jest, by nasz głos był spokojny, merytoryczny i dojrzały, a nie był głosem jakiegoś rozwydrzonego hejtera. Oczywiście trzeba być realistą, zawsze będą nam towarzyszyć głosy skrajne i opinie niepoważne. Tak jak podczas zwykłych spotkań wyborczych znajdzie się ktoś, kto wypowie głos frustracji, użyje wulgaryzmów albo wyda opinie niesprawiedliwą, tak samo i w internecie znajdą się ludzie, którzy pod własnym nazwiskiem i pod anonimowymi pseudonimami będą pisali rzeczy przykre i nieprzyjemne. Nie ma żadnego sposobu na wyeliminowanie tego. Tak jak życie społeczne jest pełne tego, z czym się nie zgadzamy - tak samo dzieje się to w sieci. Przypomnijmy, że na tych platformach każdy ma możliwość ustanowić swoje forum lub swój profil i w ich ramach może prowadzić bardziej restrykcyjną politykę regulacyjną. To jest możliwe - to już jest sfera wolności administratora każdej pojedynczej strony i każdej pojedynczej grupy.

Jeżeli czyjeś głosy się komuś nie podobają, to osoba ta może po prostu takiego użytkownika wyciszyć i dyskutować w gronie ludzi kulturalnych. To jest sfera interakcji pomiędzy nami, obywatelami, którzy wzajemnie decydują, z kim chcą rozmawiać a z kim nie. Natomiast to nie jest sfera decyzji platform, aby ludzi, mających pewne cechy charakteru osobowości albo pewne poglądy wyciszać. Jeśli na taki mechanizm się zgodzimy, w naturalny sposób skończy się to cenzurą ideologiczną i polityczną. Jak stwierdzić, która przykra opinia dla określonej osoby jest dopuszczalna, a która nie - kto miałby o tym decydować?

Panie pośle, jednak moje pytanie odnosi się bardziej do kwestii propagowania mowy nienawiści, dehumanizowania, wyśmiewania....

Zwracam uwagę, że w polskim prawie nie ma pojęcia mowy nienawiści. Jest to kalka językowa z angielskiego. W polskim kodeksie karnym penalizowanym zjawiskiem jest nawoływanie do nienawiści - mamy orzecznictwo sądów, które pozwala nam rozpoznać czym różni się negatywna opinia na dany temat od publicystyki, która może być prześmiewcza czy zadziorna od nawoływania do nienawiści. Wydaje mi się, że każdy wykształcony Polak, mając odrobinę wyczucia społecznego, jest wstanie tę różnicę zauważyć. W tej chwili mamy trend poprawności politycznej, który próbuje różne negatywne opinie zakwalifikować jako mowę nienawiści. Natomiast my nie możemy dać się zwariować - takie treści muszą być po prostu dozwolone. Jeżeli odmówimy sobie nawzajem prawa do krytyki siebie, swoich cech, poglądów i pomysłów, to zlikwidujemy wolność słowa. Trzeba nauczyć się z tym żyć, że jesteśmy poddawani codziennej krytyce. To jest normalne.

Jednak czym innym jest krytyka, a czym innym nękanie, wyśmiewanie czy dehumanizowanie w sieci. Czy jednak ograniczenie platformom możliwości reagowania na te zjawiska nie spowoduje ich zwielokrotnienia?

Jeżeli nękanie jest problemem, to należy to rozpatrzyć od strony prawnej. Już chyba w tej chwili jest takie przestępstwo lub wykroczenie jak stalking czy nękanie. Jeżeli ktoś czuje się ofiarą tego typu przestępstwa, może zgłosić to do odpowiednich organów.

Nękanie i obrażanie to są terminy, który każdy może rozumieć inaczej. Jeżeli nękanie przybiera charakter przestępczy, powinno to być przedmiotem zgłoszenia na policję. W tej chwili platformy nie proponują żadnego sposobu ochrony przed nękaniem innego niż zablokowanie użytkownika, który w sposób przesadny na kimś się skupia lub go atakuje. Uważam, że zablokowanie kogoś, kto nęka jest najbardziej skutecznym sposobem rozwiązaniem tego problemu i to narzędzie jest dostępne - co więcej mogą stosować go sami użytkownicy - nie ma tu żadnej potrzeby ingerencji platform. Jeżeli ktoś uważa, że jest nękany w takiej skali, że wymaga to działania organów, powinien po prostu zgłosić to na policję. Jeżeli zaś chodzi o obrażanie kogokolwiek to zwracam uwagę, że mamy w Polsce przestępstwo znieważenia i zniesławienia i na tej podstawie treści mogą być usunięte. Natomiast obrażanie kogoś, nie mające charakteru znieważenia i zniesławienia, jest po prostu legalną krytyką. Oczywiście ktoś może się za to obrazić, jednak na tym polega wolność słowa, że jako obywatele możemy nawzajem wyrażać swoje opinie, że krystalizujemy je na różne sprawy, także oceniając część swoich cech, pomysłów, opinii czy przekonań negatywnie. Ktoś może uważać, że jest to obrażanie, jednak życie składa się z tego, że jesteśmy podzieleni i mamy różne poglądy. Jeżeli nie ma to charakteru przestępstwa znieważenia lub zniesławienia, wówczas trzeba z tym żyć.

Z praktyki wiemy, że policja i prokuratury mają ograniczone możliwości, jeśli chodzi o ustalanie użytkowników anonimowych kont lub podających fałszywe dane. Sprawy, w których obraża nas użytkownik występujący pod nickiem będą toczyły się latami, o ile w ogóle znajdą szczęśliwe zakończenie. Czy Państwa propozycja uwzględnia rozwiązanie tego problemu?

Uważam, że powinny być ustanowione przepisy umożliwiające tzw. ślepy pozew, a więc pozwanie kogoś, kogo tożsamości nie znamy, a następnie przerzucenie na sądy ustalenia tożsamości tej osoby. Po drugie, uważam, że powinien to być mechanizm umożliwiający wyciągnięcie konsekwencji wobec takiej osoby. Konieczne jest, że jeśli sąd ustali, że rzeczywiście ktoś, kogo tożsamości nie znamy, faktycznie prowadzi działalność polegającą na znieważeniu, zniesławianiu, nękaniu lub innego rodzaju przestępstwie, możliwe było wyciągnięcie konsekwencji polegającej na przepadku narzędzia przestępstwa, czyli profilu. Wówczas platformy mogłyby wykonywać wyrok sądu.

Na początku jednak potrzebne jest narzędzie umożliwiające nam pozwanie niezidentyfikowanej osoby. Obecnie osoba, która jest ofiarą takich procederów, nie może złożyć zawiadomienia do momentu, w którym sama sobie nie ustali tożsamości sprawcy. Wiadomo, że raczej brak nam takich możliwości - co jest sytuacją kuriozalną. To nie jest problem z platformami, tylko z polskim systemem prawnym.

Jeszcze raz wskażę, że jeżeli chcemy być wolnymi obywatelami oraz poważnie traktujemy swoje państwo i wymiar sprawiedliwości, to musimy upatrywać ochronę swoich praw w polskich instytucjach, a nie w anonimowych pracownikach międzynarodowych korporacji, które nigdy nie będą miały interesu w tym, żeby chronić nasze prawa, ponieważ kierują się przede wszystkim ochroną własnej pozycji rynkowej i jej spieniężaniem.

Czy widzą Państwo jako siła polityczna możliwość współpracy z rządem w tym zakresie?

Jesteśmy gotowi do współpracy z każdą siłą polityczną, która w tym zakresie przedstawi przepisy lub propozycje ustawy, poprawiającej aktualny stan prawny. Przyjęcie zaproszenia w 2016 roku od lewicowego Rzecznika Praw Obywatelskich było z naszej strony wyrazem otwartości. Podczas spotkania zgodziliśmy się z częścią organizacji, które mają lewicowy profil. To zdumiewające, ale na tym spotkaniu zgoda miała charakter ponadpolityczny - o tym, że to polskie przepisy prawne powinny zdefiniować granicę wolności słowa, a międzynarodowe korporacje powinny się do tego dostosować.

Czekamy aż rząd przedstawi projekt przepisów, o których mówił (rozmowa odbyła się przed ogłoszeniem przez resort sprawiedliwości projektu ustawy - przyp. red.) - akcja cenzorska, która wystąpiła w Stanach Zjednoczonych jest dobrym na to momentem. Pozwoli to pokazać Polskę jako kraj premiujący swobodę wypowiedzi jako punkt odniesienia w debacie publicznej. Możemy nawet wyprzedzić instytucje unijne, bo przypomnijmy, że struktury te również pracują nad swoimi przepisami (Digital Services Act – przyp. red.), które również będą dotykały tych kwestii. Byłoby całkiem fajnie, gdyby polskie ustawodawstwo było pierwsze i stało się punktem odniesienia dla debaty europejskiej.

Na koniec chciałbym jeszcze dodać kilka zdań odnośnie postulatu, który chciałbym podnieść - a mianowicie co należy zrobić, aby rynek platform społecznościowych nie ulegał tak silnej koncentracji jak nastąpiło to w tej chwili. W mojej ocenie platformy społecznościowe urosły do rangi problemu politycznego. Stało się to, ponieważ dotychczas brak było standardu, który musiały one spełnić w odniesieniu do superintratnych danych odnoszących się do informacji jak żyją, co robią i czym się interesują już w tej chwili miliardy ludzi. Żadna instytucja państwowa, żadna służba specjalna nigdy nie posiadała tak obszernych danych o upodobaniach, interakcjach, sieciach społecznych, którymi obecnie dysponuje Facebook i kilka innych największych platform społecznościowych. Co więcej, z uwagi na fakt, że twórcy treści - niezależnie czy są to komercyjne firmy, liderzy opinii czy politycy - wszyscy szukają dużego audytorium. W naturalny sposób platformy te mają tendencję do coraz bardziej pogłębiającej się koncentracji, a wszyscy mamy tendencję do koncentrowania się na największych graczach na rynku. Odpowiedzią na to wyzwanie w mojej ocenie i zdaniem wielu ekspertów jest konieczność - poprzez pewną standaryzację czy poprzez porozumienia międzynarodowe - wymuszenia interoperacyjności platform społecznościowych. Czyli, aby funkcjonowały one tak, jak funkcjonują serwery e-mail, operatorzy telefonów komórkowych czy banki - niezależnie na którym serwerze mamy założone konto e-mail, w którym banku mamy pieniądze czy u którego operatora mamy numer telefonu - jesteśmy w stanie wysłać e-mail, zadzwonić lub wysłać przelew do każdego kto ma konto gdzieś indziej.

Podobnie mogłoby to działać w mediach społecznościowych. Chodzi o to, aby operatorzy naszych danych - w tym wypadku Twitter, Facebook, Instagram - przestali być operatorami, którzy komunikują się wyłącznie sami ze sobą. Abyśmy, np. będąc użytkownikami Twittera, mogli śledzić konta na Facebooku. Abyśmy będąc użytkownikami Facebooka mogli otrzymywać powiadomienia z Twittera, abyśmy w końcu uciekając na totalnie nie mainstreamowe platformy mogli jednocześnie śledzić źródła lub mieć kontakt z osobami, które są użytkownikami dużych portali.

Oczywiście każda z tych platform mogłaby proponować swoje specyficzne usługi, aby zachęcić ludzi do siebie. Chodzi o to, żeby istniał pewien protokół komunikowania się pomiędzy platformami, aby cyrkulacja informacji następowała nie tylko w obrębie jednego środowiska. Stworzy to możliwość powrotu do złotych czasów internetu, kiedy funkcjonował on w oparciu o rozproszone blogi, strony internetowe czy serwery, na których były grupy dyskusyjne. Ten czas mógłby powrócić, gdyby zacząć implementować powszechnie protokół umożliwiający komunikowanie się ze wszystkimi mniejszymi graczami na rynku. Nie wyklucza to możliwości nadania swojej własnej specyfiki określonemu medium, ale pozwala na elementarną wymianę informacji i nie traktowania tych danych jako własność prywatnej. Umożliwi to także oferowanie różnych modeli biznesowych.

Takie rozwiązania już funkcjonują w niektórych oddolnie utworzonych platformach. Działają one w oparciu o protokół, który rozwinął się w ostatnich latach. Wyzwaniem, jakie stoi przed nami jest właśnie to, aby te największe korporacje przestały zazdrośnie chronić raz już zdobytego klienta i pozwoliły uczynić internet naprawdę wolnym, czyli takim, w którym informacje przepływają w sposób swobodny. Pozwoliłoby nam to stworzyć wspólną sieć, a nie sprywatyzowane, komercyjne, odseparowane od siebie silosy kontrolowane przez kilku graczy, którzy są w stanie się zmówić - tak jak zrobiło to Apple i Google, aby usunąć aplikację Parler i tym samym blokując tak naprawdę funkcjonowanie tego środowiska na telefonach 99% użytkowników. To jest wyzwanie polegające na konieczności zbudowania pewnej neutralności sprzętu telekomunikacyjnego, uniemożliwiające dostarczycielom systemów operacyjnych na telefony blokować konkurujące na rynku aplikacje. To jest w oczywisty sposób praktyka monopolistyczna.

Dostarczyciele usług nie powinni mieć prawa usuwania aplikacji, ponieważ nie podoba im się to, o czym na tych aplikacjach dyskutują użytkownicy. Osobiście mam żal do polskiego rządu, że nie ostrzega swoich obywateli przed aplikacją Messenger. Polacy bezkrytycznie powierzają swoje dane prywatnemu podmiotowi z zagranicy, który staje się właścicielem naszych prywatnych konwersacji. Dlatego ja absolutnie jej nie używam, ponieważ to co się tam pisze, nie ginie. Co więcej może to również trafić do wielu osób - poprzez możliwość wysyłania zapytań polskich służb do Facebooka. A skoro mogą robić to służby specjalne, mogą również inne organizacje, które mają swoje źródła.

Serwis CyberDefence24.pl otrzymał tytuł #DigitalEUAmbassador (Ambasadora polityki cyfrowej UE). Jeśli są sprawy, które Was nurtują; pytania, na które nie znacie odpowiedzi; tematy, o których trzeba napisać – zapraszamy do kontaktu. Piszcie do nas na: [email protected].

Krajowy system e-Faktur - co musisz wiedzieć o KSEF?

Materiał sponsorowany