- WIADOMOŚCI

To koniec deepfake? Nowe narzędzie Intela

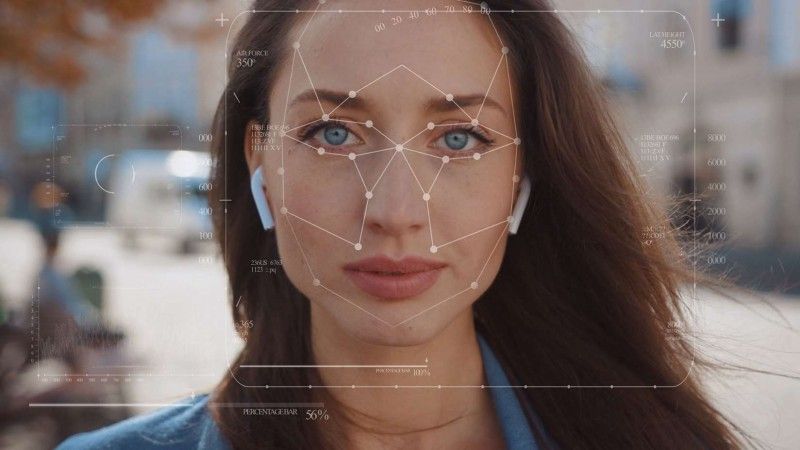

Deepfake, czyli fałszywe materiały wideo i/lub audio stworzone przy pomocy algorytmów uczenia maszynowego, to jedno ze współczesnych zagrożeń, na które – poza ludzkim okiem i uważnością – do tej pory nie było sposobu. Być może aż do teraz. Firma Intel testuje detektor fałszywych materiałów i chwali się, że wykrywa je z dokładnością równą 96 proc.

Autor. Intel - oficjalna strona internetowa

O mechanizmach tworzenia deepfake’ów i zagrożeniach z nimi związanych piszemy regularnie na łamach CyberDefence24.pl. Ekspert Demagoga na naszych łamach tłumaczył także, jak odróżniać deepfake’i na co zwracać uwagę w namierzaniu tego typu fałszywych materiałów audio czy też wideo.

Jednym z takich przykładów było między innymi wideo z prezydentem Wołodymyrem Zełenskim, który miał rzekomo przekazać ukraińskim żołnierzom, by zlożyli broń i się poddali. Fejk był wypuszczony przez Rosjan, jednak nie dość, że był technicznie po prostu słabo wykonany, to jeszcze szybko został zdementowany przez samego prezydenta Ukrainy.

Dynamiczny rozwój sztucznej inteligencji sprawia, że należy się jednak spodziewać, iż technologia służąca do generowania fałszywych treści jeszcze będzie się rozwijać. Masowa produkcja deepfake’ów będzie znacznie szybsza i łatwiejsza.

Deepfake – jak rozpoznać?

Zespół testuje system „FakeCatcher”, działający w czasie rzeczywistym w oparciu o procesory Intel Xeon. Ma on między innymi analizować ruch gałek ocznych, spojrzenie czy zmiany w przepływie krwi, których nie ma w twarzach tworzonych przez technologię, co tłumaczy jeden z badaczy firmy w rozmowie z serwisem BBC. System, analizując poszczególne cechy twarzy obecnej na zdjęciu/wideo ma odróżniać w ciągu kilku sekund autentyczne materiały od fałszywych.

Firma twierdzi, że jej skuteczność sięga 96 proc., jednak z testów dziennikarzy BBC wynika, że w przypadku analizy prawdziwego wideo kilka razy system miał problem – autentyczne uznawał za fałszywkę. Znaczenie ma także jakość – im bardziej rozmyty obraz, tym trudniej wykryć znaki szczególne. Na razie istnieje też problem z dźwiękiem, co akurat – w przypadku wysłuchania nagrania przez człowieka może sprawiać, że uda się rozpoznać fejk.

Jak na razie zatem trudno jest ocenić technologię FakeCatcher – mimo zapewnień firmy Intel – co do jej wysokiej skuteczności. Przykładowo, na próbce 140 fałszywych filmów system miał rozpoznać 91 proc. z nich. Wszystko wskazuje więc na to, że wciąż trzeba będzie poczekać, kiedy technologia przestanie się mylić.

Serwis CyberDefence24.pl otrzymał tytuł #DigitalEUAmbassador (Ambasadora polityki cyfrowej UE). Jeśli są sprawy, które Was nurtują; pytania, na które nie znacie odpowiedzi; tematy, o których trzeba napisać – zapraszamy do kontaktu. Piszcie do nas na: [email protected].

Krajowy system e-Faktur - co musisz wiedzieć o KSEF?

Materiał sponsorowany