- WIADOMOŚCI

- WAŻNE

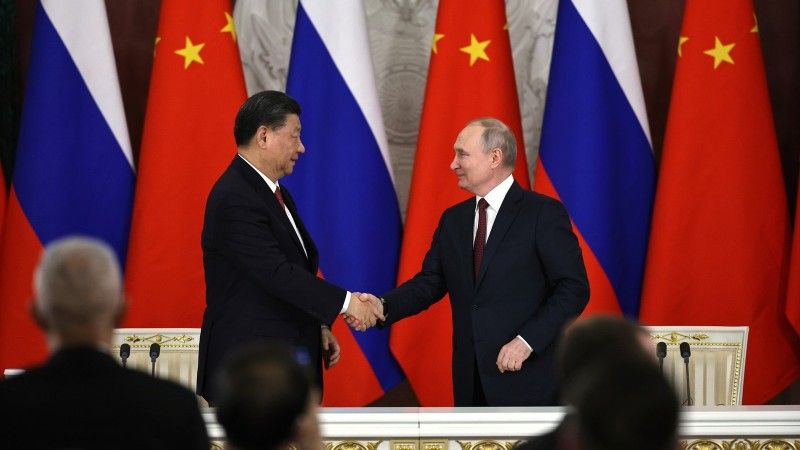

Nowa wojna o umysły. Rosja i Chiny śmielej sięgają po narzędzia wpływu

Rosja i Chiny coraz śmielej sięgają po dezinformację jako narzędzie wpływu geopolitycznego. Najnowszy raport ujawnia skalę manipulacji. Setki operacji, dziesiątki tysięcy kanałów i zasięgi sięgające całego świata – wojna informacyjna trwa: od Ukrainy po Sahel, od Tajwanu po Zachodu.

Autor. Presidential Executive Office of Russia/Wikimedia Commons/CC4.0

W marcu 2025 r. Europejska Służba Działań Zewnętrznych (EEAS) opublikowała „Raport o zagrożeniach wynikających z obcej manipulacji i ingerencji informacyjnej”. Dokument pokazuje, że przestrzeń informacyjna stała się równorzędnym teatrem rywalizacji geopolitycznej: Rosja i Chiny łączą narzędzia dyplomatyczne, operacje wojskowe oraz dezinformacyjne, aby polaryzować społeczeństwa, podkopywać procesy wyborcze i osłabiać partnerstwa zachodnie.

Metodologia EEAS i czterowarstwowa Macierz FIMI

Trzon raportu stanowi FIMI Exposure Matrix – model dzielący infrastrukturę propagandową na cztery kręgi:

- Oficjalne kanały państwowe (np. Ministerstwo Spraw Zagranicznych Federacji Rosyjskiej, konta ambasad Chińskiej Republiki Ludowej);

- Media kontrolowane przez państwo – Russia Today, Sputnik, agencja TASS, China Global Television Network, dziennik „Global Times";

- Kanały powiązane ze służbami – portale finansowane przez Federalną Służbę Bezpieczeństwa czy chińskie Ministerstwo Bezpieczeństwa Państwowego, lecz ukrywające patrona;

- Kanały „state-aligned" – blogi, grupy w Telegramie, influencerzy, którzy stale wzmacniają przekaz Kremla lub Pekinu bez formalnego łańcucha finansowania.

Macierz łączy dane techniczne (IP, hostingi, identyczny kod witryny, ślady płatności) i wskaźniki behawioralne (jednoczesne publikacje, tożsame słownictwo, kopiowanie nagłówków).

Statystyka roku 2024 – skala, zasięg, platformy

Między listopadem 2023 a listopadem 2024 r. analitycy EEAS wykryli 505 incydentów FIMI obejmujących 90 krajów i 38 000 unikalnych kanałów. Zgromadzono 68 000 nośników treści (filmy, tweety, memy).

X (dawniej Twitter) odpowiadał za 88 proc. całej aktywności; drugie miejsce zajęły strony WWW – często rejestrowane w tzw. bullet-proof hostingu. Meta Platforms (Facebook, Instagram) pozostaje kluczowa dla targetowanych reklam politycznych, a Telegram oraz TikTok dla wiralowych filmów.

Najczęściej atakowanym państwem była Ukraina (prawie połowa przypadków), następnie Francja (152 incydenty, głównie w związku z Igrzyskami 2024 i kampanią parlamentarną), Niemcy (73), Mołdawia (45) oraz kraje Sahelu.

Rosyjskie wektory wpływu: od Ukrainy po Sahel

Moskwa łączy media państwowe (Russia Today, Sputnik, RIA Nowosti) z kampaniami „pod fałszywą flagą”. Operacja Doppelgänger (analiza EUvsDisinfo klonowała strony „Le Monde”, „Le Parisien”, „Der Spiegel” i „The Guardian”, aby publikować teksty o „dyktacie Brukseli”. W Mołdawii sieć Portal Kombat (raport VIGINUM zalała rynek lokalnymi wersjami rosyjskiej propagandy, a deepfake z głosem prezydent Mai Sandu oskarżał rząd o handel organami.

W Afryce rosyjska African Initiative przejęła schedę po Grupie Wagner, publikując artykuły w sześciu językach i szkoląc „dziennikarzy” w Wagadugu. Kanały RT Africa i Sputnik Afrique promują przekaz o „neokolonializmie Paryża” i przedstawiają Moskwę jako gwaranta bezpieczeństwa.

Chińska strategia outsourcingu propagandy

Pekin preferuje scentralizowany przekaz, lecz chętnie zleca brudną robotę firmom PR. Kampania HaiEnergy – 316 stron zarządzanych przez Shanghai Haixun Technology – podszywa się pod gazety regionalne w USA i UE, wklejając materiały agencji Xinhua. Operacja Paperwall, opisana przez Citizen Lab, to 123 serwisy w 30 krajach zlecone firmie Shenzhen Haimai-yunxiang Media.

Obie sieci mają wpływać na wyniki wyszukiwania i tworzyć wrażenie zachodniego poparcia dla chińskiej polityki wobec Tajwanu czy Morza Południowochińskiego.

Technologie i taktyki: botnety, deepfake'i, portale-widma

- Botnety i CIB – 28 000 z 38 000 kont to profile jednorazowe.

- Podszywanie się – 127 przypadków klonowania marek (Frankfurter Allgemeine Zeitung, Der Spiegel.

- Deepfake'i – 41 incydentów; Microsoft Threat Analysis Center

- opisał

- rosyjskie wideo z wiceprezydent Kamalą Harris.

- Reklamy targetowane – sieci Meta wykorzystane do mikrotargetingu np. rolników w Niemczech.

Studium przypadku I – referendum i wybory w Mołdawii

Kreml rzucił pełne spektrum narzędzi: rzeczniczka MSZ Rosji Marija Zacharowa atakowała prezydent Sandu oficjalnie, a sieć Portal Kombat doiła autoprzetłumaczone teksty ze Sputnika.

W dniu głosowania na Telegramie krążył deepfake z głosem Sandu „przyznającej się” do fałszerstw. Cel: zablokować kurs na Unię Europejską.

Studium przypadku II – rosyjska soft-power w Afryce

African Initiative działa dwutorowo: własne treści trafiają do serwisów RT International jako „głos kontynentu”, a materiały RT są tłumaczone i wtłaczane do lokalnych grup na Facebooku.

W efekcie w Sahelu Rosja jawi się jako jedyny obrońca tradycji przed Zachodem i przed dżihadystami.

Studium przypadku III – chińskie „influence-for-hire”

W kampanii prezydenckiej w Tajwanie (styczeń 2024) agencja Haixun rozsyłała do sieci HaiEnergy teksty Xinhua o „prowokacjach Lai Ching-te”. Po kilku godzinach te same artykuły pojawiły się na dziesiątkach „lokalnych” portali w USA, Kanadzie i Europie, a następnie w Google News – jako rzekome opinie zachodnich ekspertów.

Eskalacja sztucznej inteligencji w kampaniach FIMI

Generatywna AI obniża koszty produkcji treści i pozwala skalować infiltrację forów w językach rzadkich. Deepfake głosu Sandu w Mołdawii, wideo z Joe Exotic popierającym Kreml (operacja Doppelgänger) czy automatyczne komentarze w suahili pod postami BBC Swahili to sygnał, że AI staje się standardem w arsenale FIMI.

Odpowiedź Unii Europejskiej: sankcje, regulacje, edukacja

W grudniu 2024 r. UE przyjęła pierwszy pakiet sankcji wymierzony wyłącznie w architektów dezinformacji (tu m.in. firmy Struktura i Social Design Agency finansujące Doppelgängera).

Digital Services Act wymusza etykietowanie reklam politycznych i szybkie zdejmowanie Coordinated Inauthentic Behaviour. Komisja uruchomiła program grantowy dla fact-checkerów (EUvsDisinfo, Bellingcat, Correctiv) oraz kampanię edukacji medialnej w szkołach.

Rekomendacje i wnioski końcowe

EEAS podkreśla, że FIMI to długofalowa strategia, nie doraźny chwyt. Walka z nią wymaga:

- analizy wyprzedzającej – łączenia danych cyber-threat-intel z Macierzą FIMI;

- kosztów dla sprawców – sankcji personalnych, blokad finansowych, ujawniania źródeł;

- pełnej przejrzystości platform – aby boty nie mogły ukrywać sponsorów;

- odporności społecznej – szkolenia z rozpoznawania deepfake'ów i krytycznej analizy źródeł.

Walka o fakty, to walka o bezpieczeństwo

„Jeśli odbiorcy uwierzą, że wszystko jest propagandą, sama prawda straci wartość – a wtedy żadna tarcza rakietowa nie obroni demokracji” – konkluduje raport.

Najnowsze ustalenia EEAS jasno dowodzą: walka o fakty to dziś walka o bezpieczeństwo europejskiego porządku politycznego.

Serwis CyberDefence24.pl otrzymał tytuł #DigitalEUAmbassador (Ambasadora polityki cyfrowej UE). Jeśli są sprawy, które Was nurtują; pytania, na które nie znacie odpowiedzi; tematy, o których trzeba napisać – zapraszamy do kontaktu. Piszcie do nas na: [email protected].

Krajowy system e-Faktur - co musisz wiedzieć o KSEF?

Materiał sponsorowany